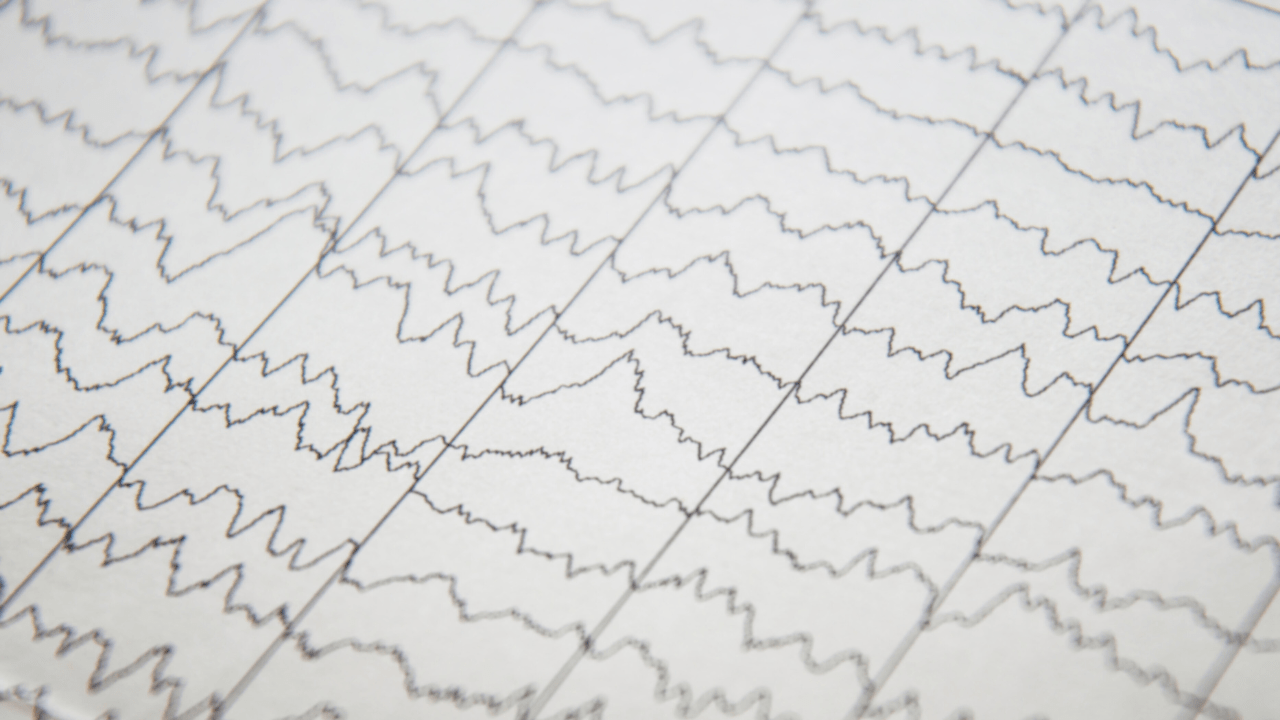

PRINCÍPIOS E TÉCNICAS DE ELETROENCEFALOGRAFIA EM NEUROCIÊNCIA

AULA 09 - Teoria da Informação: O Teorema de Shannon (parte II)

Instituto de Ciência e Tecnologia

Graduação em Engenharia Biomédica

Prof. Dr. Adenauer G. Casali

Laboratório de Neuroengenharia e Computação

casali@unifesp.br

PRINCÍPIOS E TÉCNICAS DE EEG EM NEUROCIÊNCIA

- A prova e o significado do "Shannon's source coding theorem"

- A Entropia de Shannon

- Entropia Conjunta

- Informação Mútua

- Entropia Condicional

Adenauer G. CASALI

AULA 09

Nesta aula, nós veremos...

1. Shannon's source coding theorem

Princípios e Técnicas de EEG

Aula 09

1. Shannon's source coding theorem

Princípios e Técnicas de EEG

Aula 09

H(X) é um limite superior da informação contida em X para N grande!

1. Shannon's source coding theorem

Princípios e Técnicas de EEG

Aula 09

1. Shannon's source coding theorem

Princípios e Técnicas de EEG

Aula 09

1. Shannon's source coding theorem

Princípios e Técnicas de EEG

Aula 09

1. Shannon's source coding theorem

Princípios e Técnicas de EEG

Aula 09

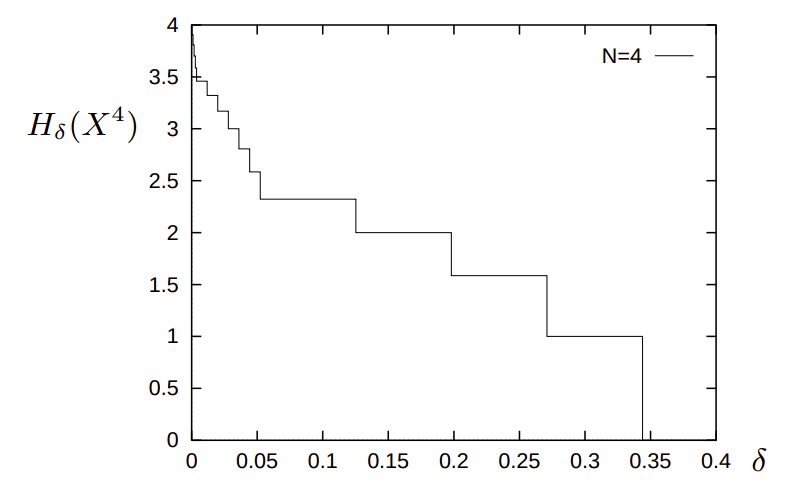

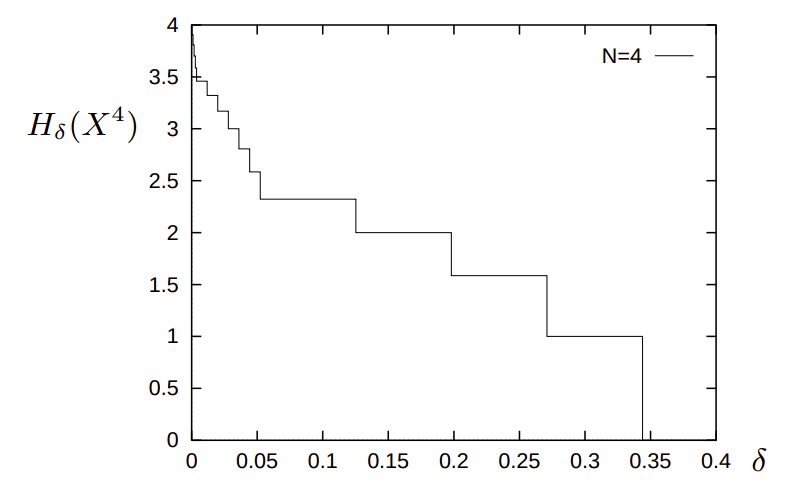

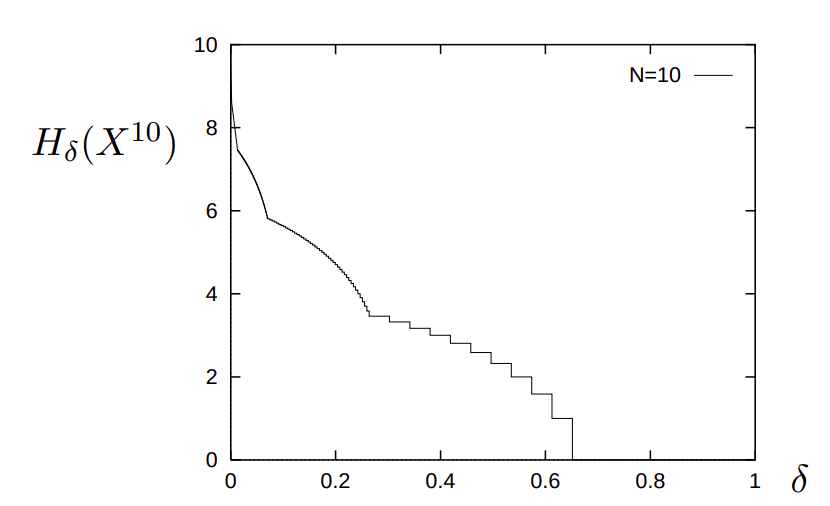

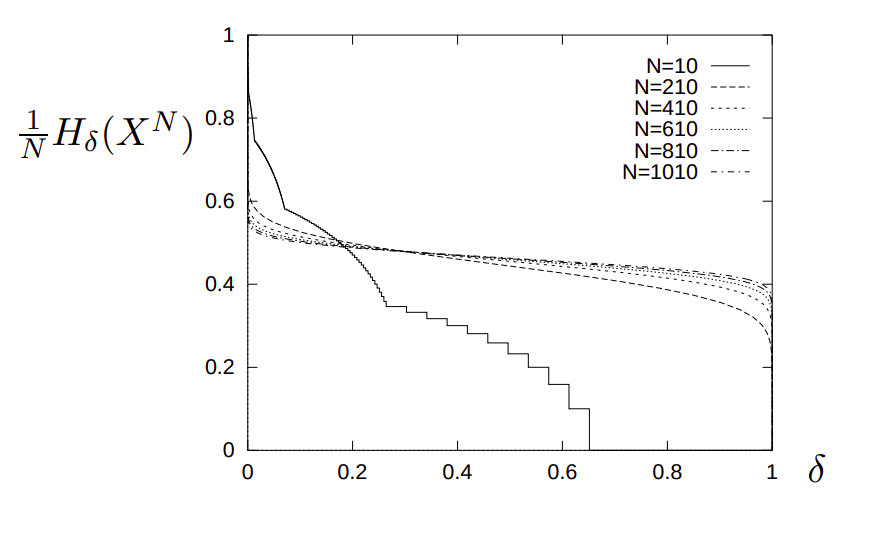

Fonte: MacKay, cap. 2

1. Shannon's source coding theorem

Princípios e Técnicas de EEG

Aula 09

Fonte: MacKay, cap. 2

1. Shannon's source coding theorem

Princípios e Técnicas de EEG

Aula 09

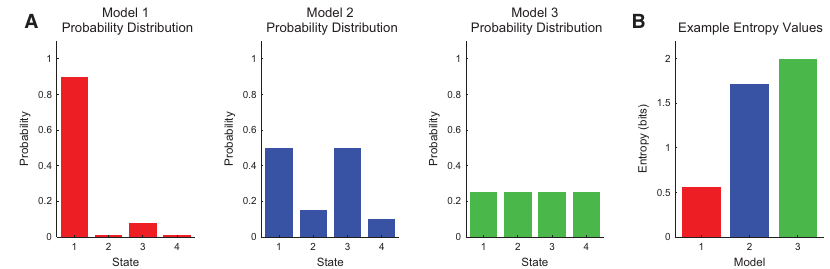

2. A Entropia de Shannon

Princípios e Técnicas de EEG

Aula 09

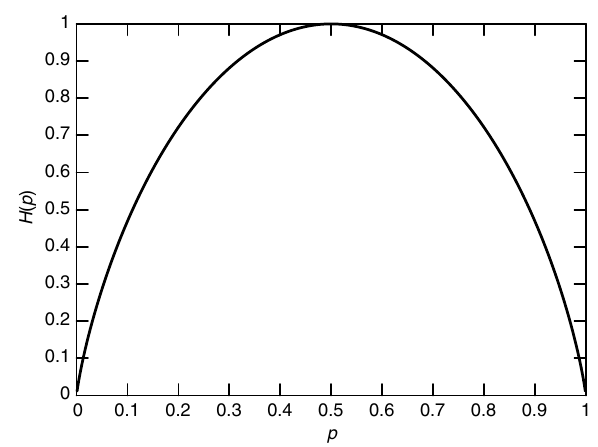

Comportamento de H para uma variável binária (com probabilidade p)

Fonte: Cover and Thomas, "Elements of Information Theory" (2006)

2. A Entropia de Shannon

Princípios e Técnicas de EEG

Aula 09

3. Entropia Conjunta (multivariada)

Princípios e Técnicas de EEG

Aula 09

Entropia multivariada

Uma variável

Duas variáveis

Entropia multivariada

Por exemplo: duas moedas que são jogadas independentemente (sem vieses)

Moeda 1 (X):

Moeda 2 (Y):

3. Entropia Conjunta (multivariada)

Princípios e Técnicas de EEG

Aula 09

De fato se os processos são independentes:

A informação contida em X + Y é igual à

informação contida em X + informação contida em Y

Informação mútua entre X e Y:

Se os processos são independentes:

3. Entropia Conjunta (multivariada)

Princípios e Técnicas de EEG

Aula 09

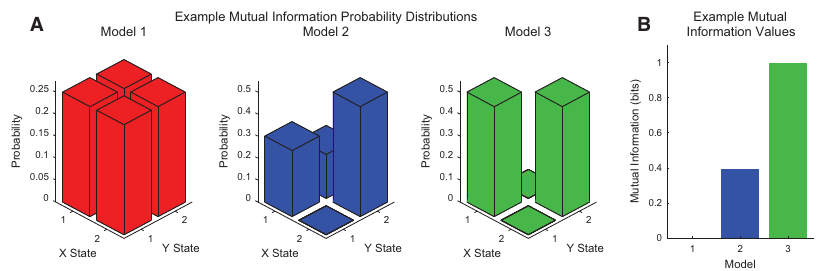

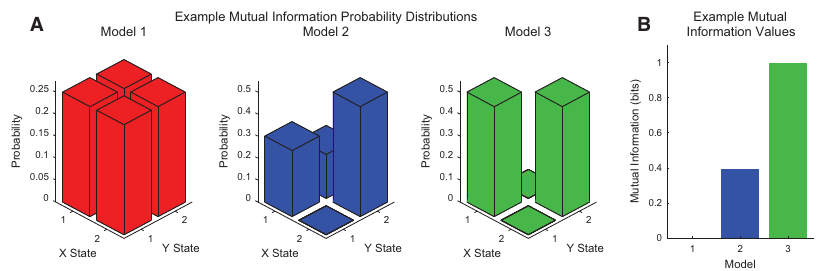

4. Informação Mútua

Princípios e Técnicas de EEG

Aula 09

Informação Mútua (Mutual Information)

Informação em X e Y conjuntamente

Informação em X e Y independentemente

MI: medida da diferença entre p(X)p(Y) e p(X,Y): chamada de distância de Kullback-Leibler

MI: também pode ser entendida como a informação que Y providencia sobre X e que X providencia sobre Y (simétrica)

4. Informação Mútua

Informação Mútua (Mutual Information)

Princípios e Técnicas de EEG

Aula 09

5. Entropia Condicional

Princípios e Técnicas de EEG

Aula 09

Entropia condicional

Medida da informação que "sobra" na variável X, depois que Y é conhecido!

Informação Mútua e entropia condicional

MI: informação em X menos a informação em X depois que conhecemos Y:

medida da informação que Y providencia sobre X

(e que X providencia sobre Y)

5. Entropia Condicional

Princípios e Técnicas de EEG

Aula 09

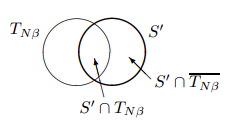

Informação Mútua e entropia condicional

Informação em X e Y

Informação em X

Informação em Y

Informação em Y

dado X (conhecido X)

Informação em X

dado Y (conhecido Y)

5. Entropia Condicional

Princípios e Técnicas de EEG

Aula 09

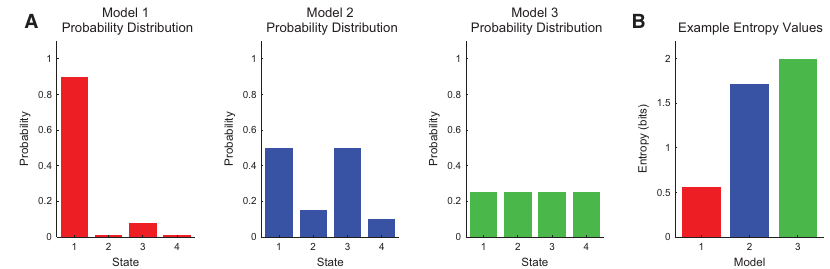

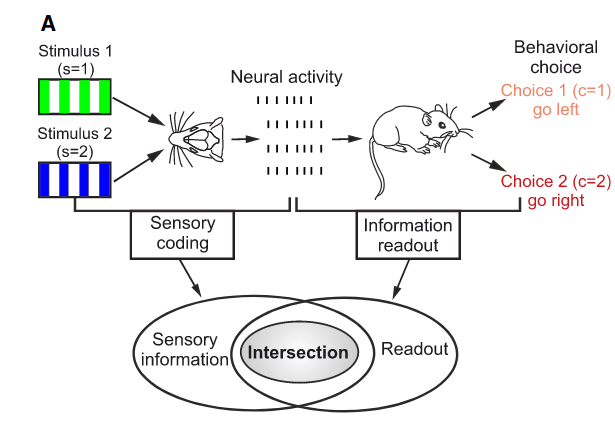

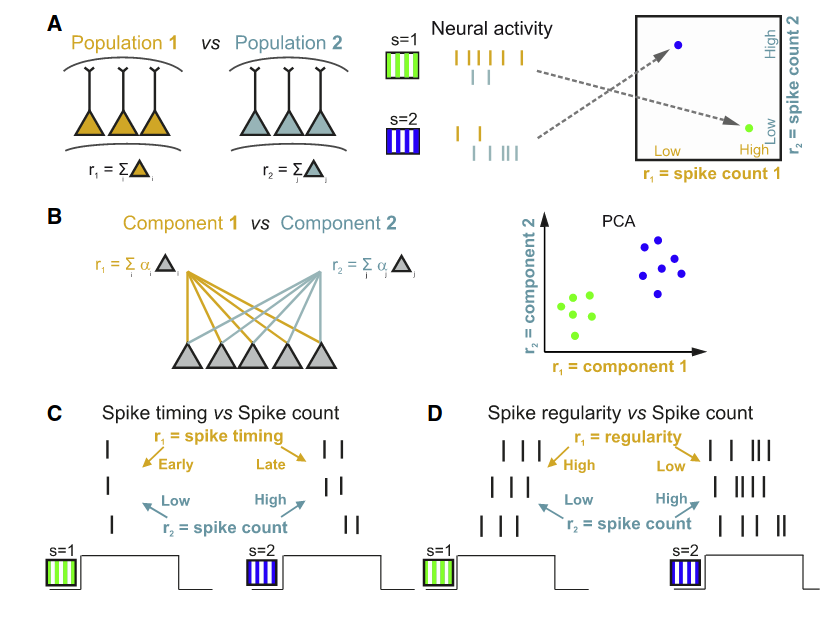

Exemplo de uso da Informação Mútua

Neural Decoding

6. Exemplo de uso da Informação Mútua

Princípios e Técnicas de EEG

Aula 09

PRINCÍPIOS E TÉCNICAS DE ELETROENCEFALOGRAFIA EM NEUROCIÊNCIA

Próximas Aulas:

AULA 10 - Pré-processamento do EEG (parte II)

AULA 11 - Pré-processamento do EEG na prática

Instituto de Ciência e Tecnologia

Graduação em Engenharia Biomédica

Prof. Dr. Adenauer G. Casali

Laboratório de Neuroengenharia e Computação

casali@unifesp.br