Model Interpretation

Зачем нужно

- Объяснение модели для заказчика

- Понять смысл происходящего

- Изучение важных признаков для улучшения модели

- Проверка стабильности модели

- Проверка отсутствия bias или дискриминации

Варианты интерпретации

- Графики для описания признаков (кластеризация, анализ остатков)

- Интерпретируемые модели

- Методы, независимые от модели

- Интерпретация моделей

- Интерпретация отдельных предсказаний

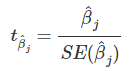

Линейные модели: t-статистика

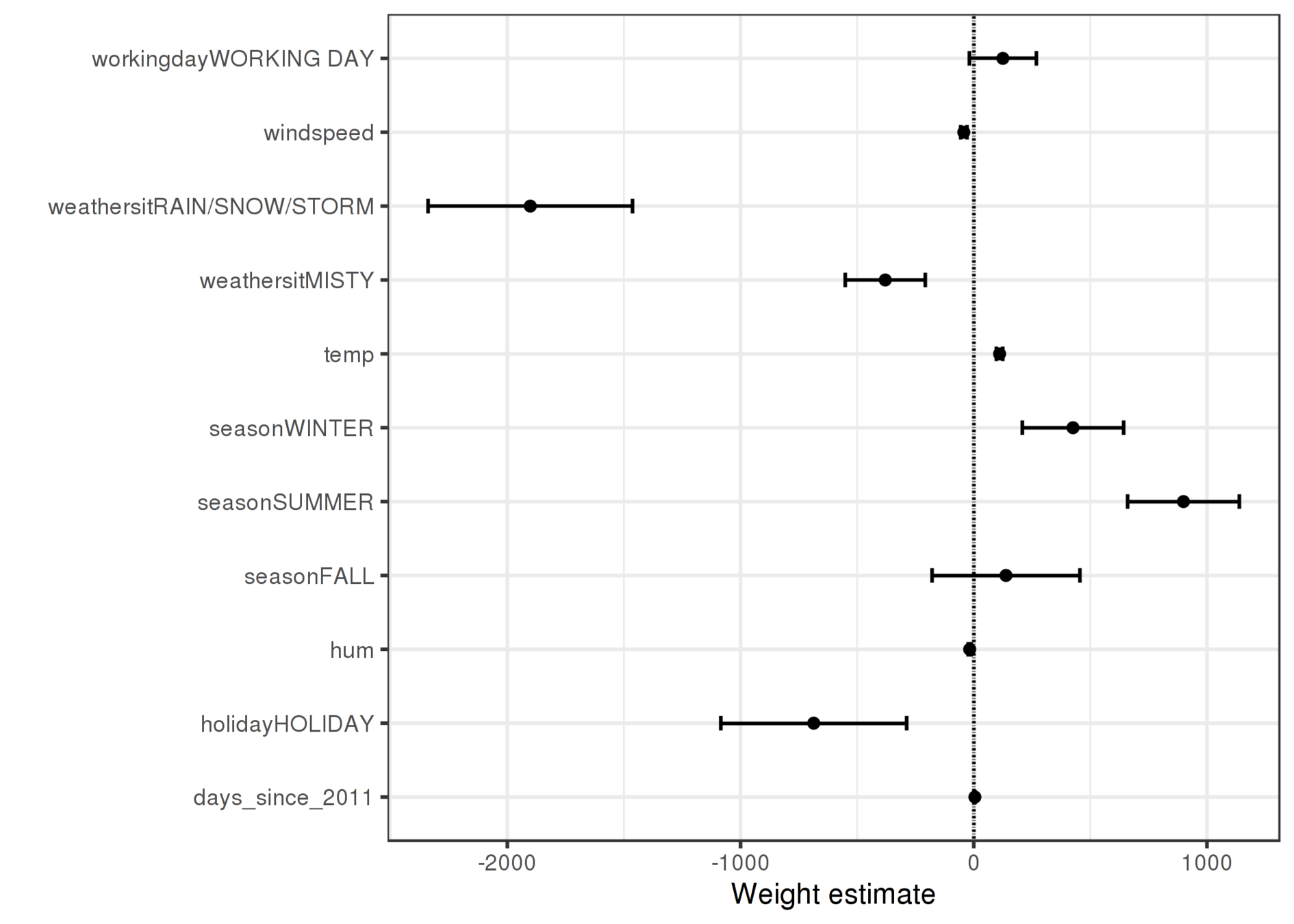

Линейные модели: effect plot

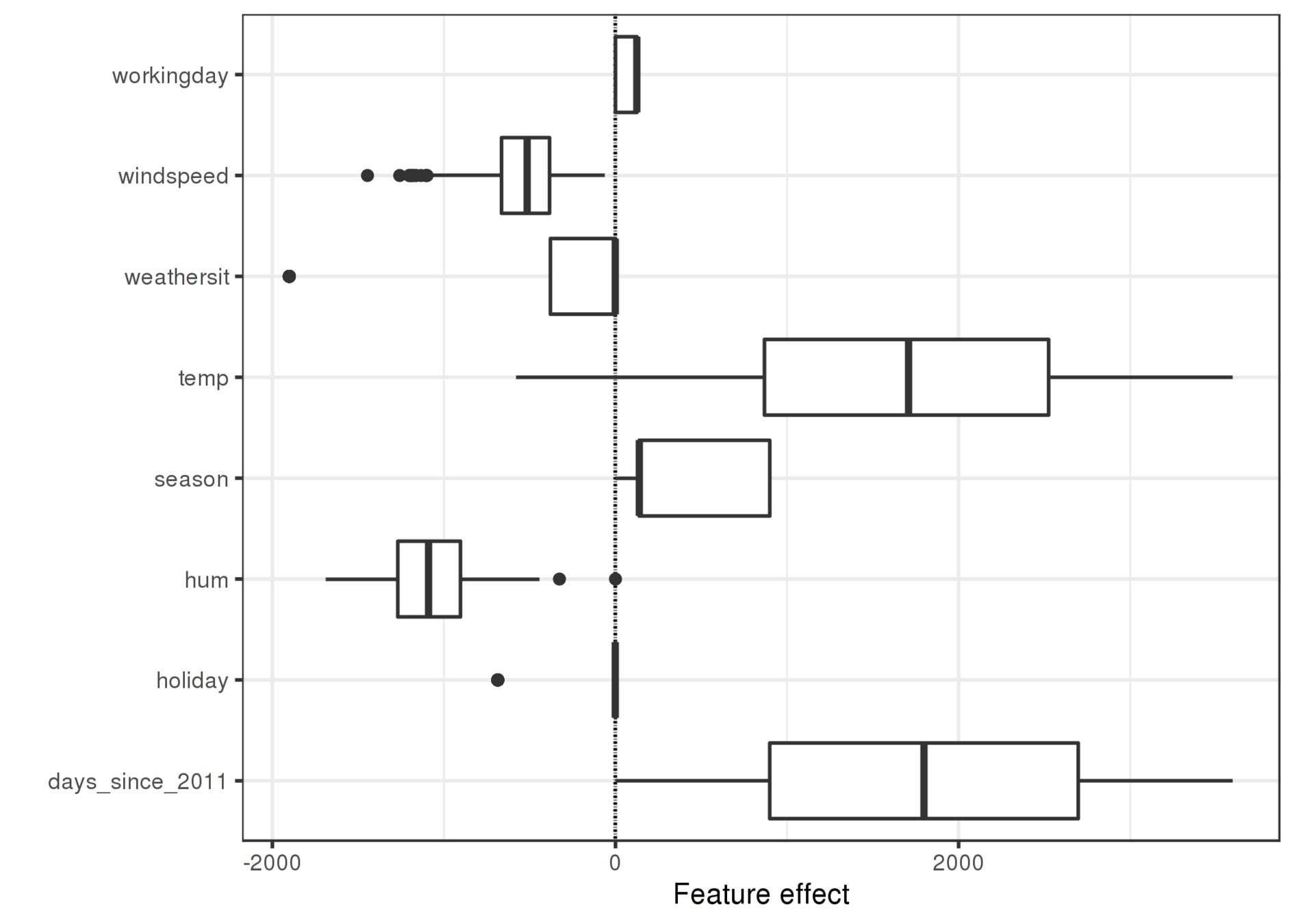

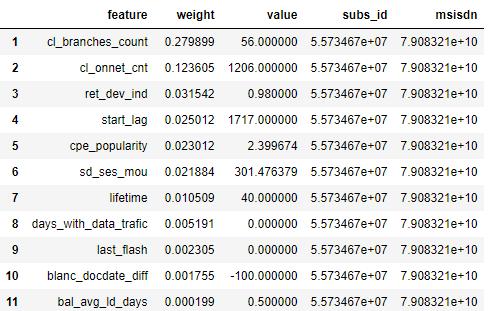

Tree-based models

Tree-based models

- Split - сколько раз признак использовался в модели

- Gain - улучшение модели от этого признака

- Cover - the average coverage of the feature when it is used in trees

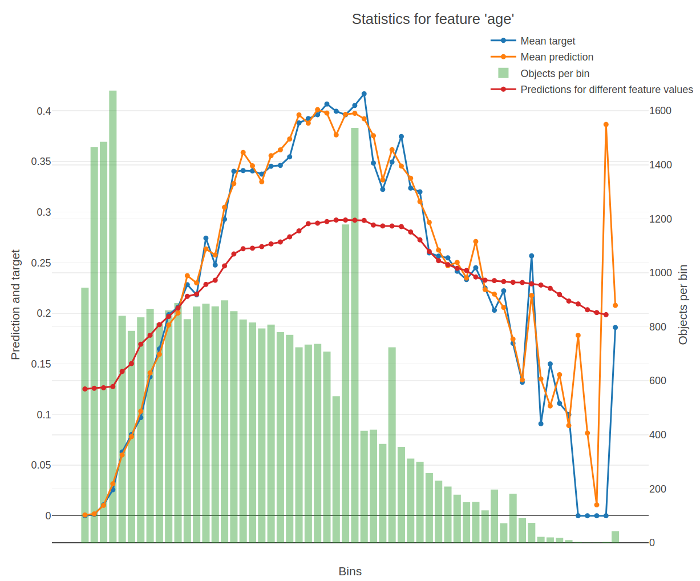

Model agnostic: means

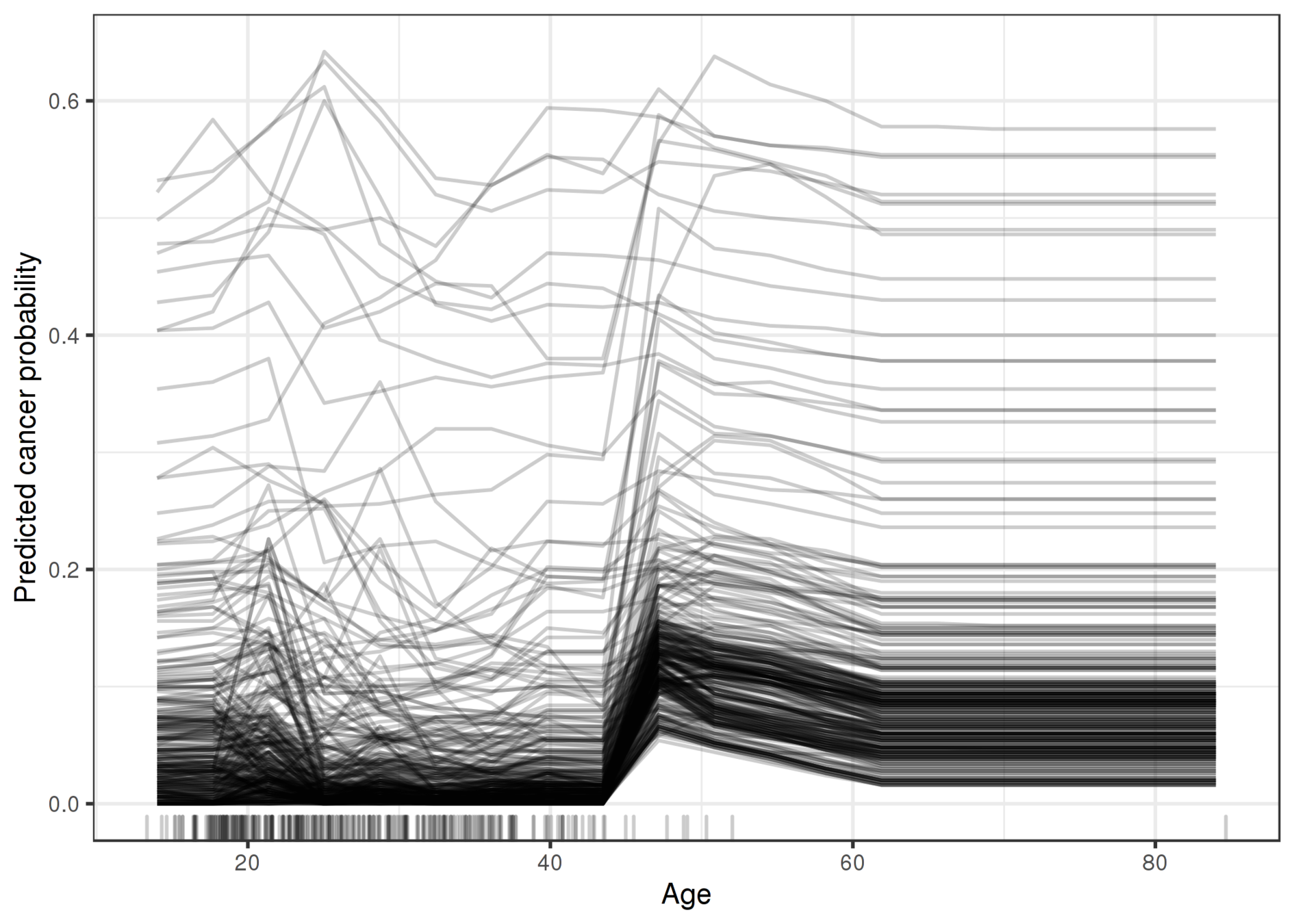

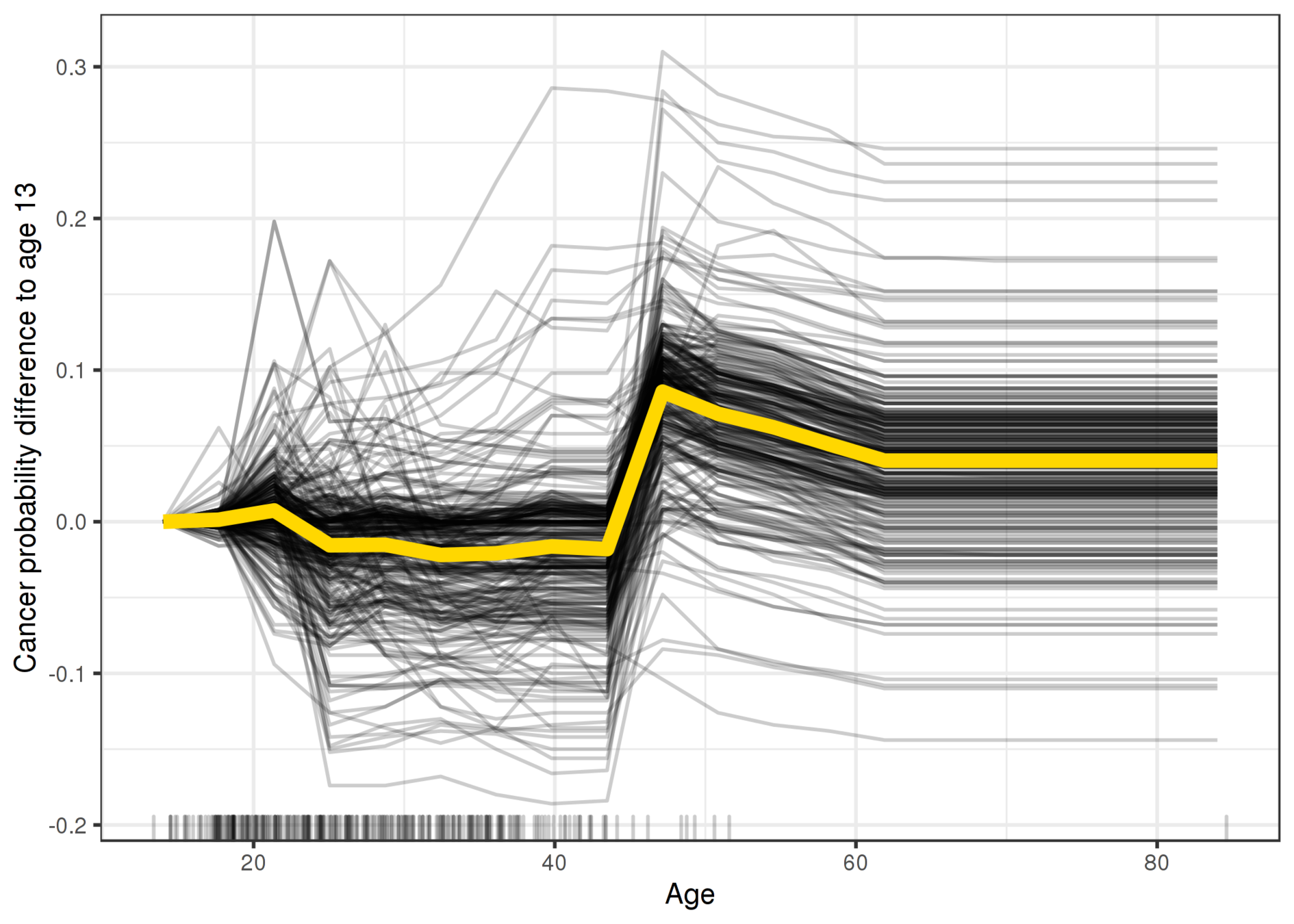

Model agnostic: ICE

Model agnostic: ICE

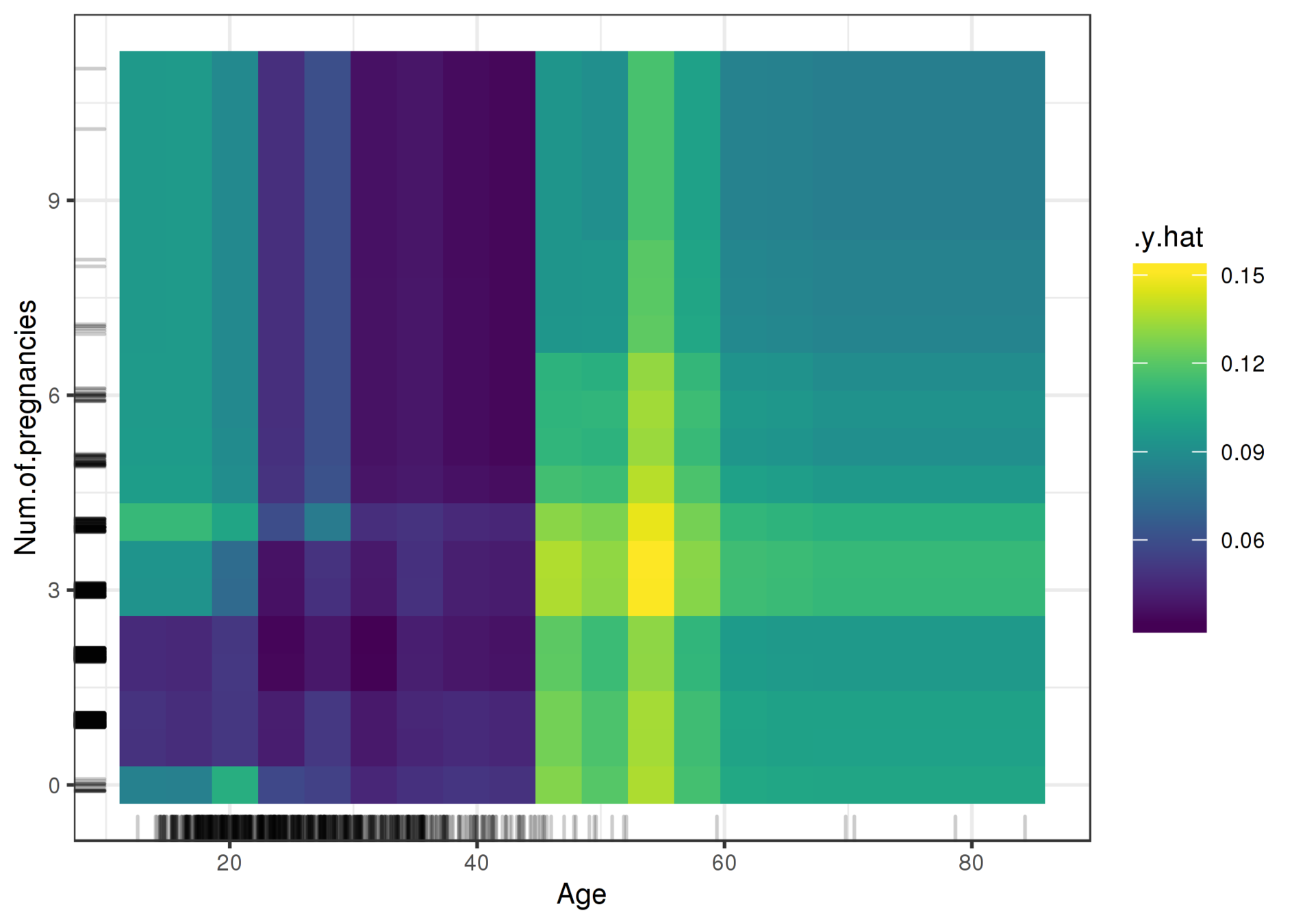

Model agnostic: PDP

Model agnostic: LOFO vs PI

LOFO:

- drop feature and retrain model

PI:

- shuffle feature

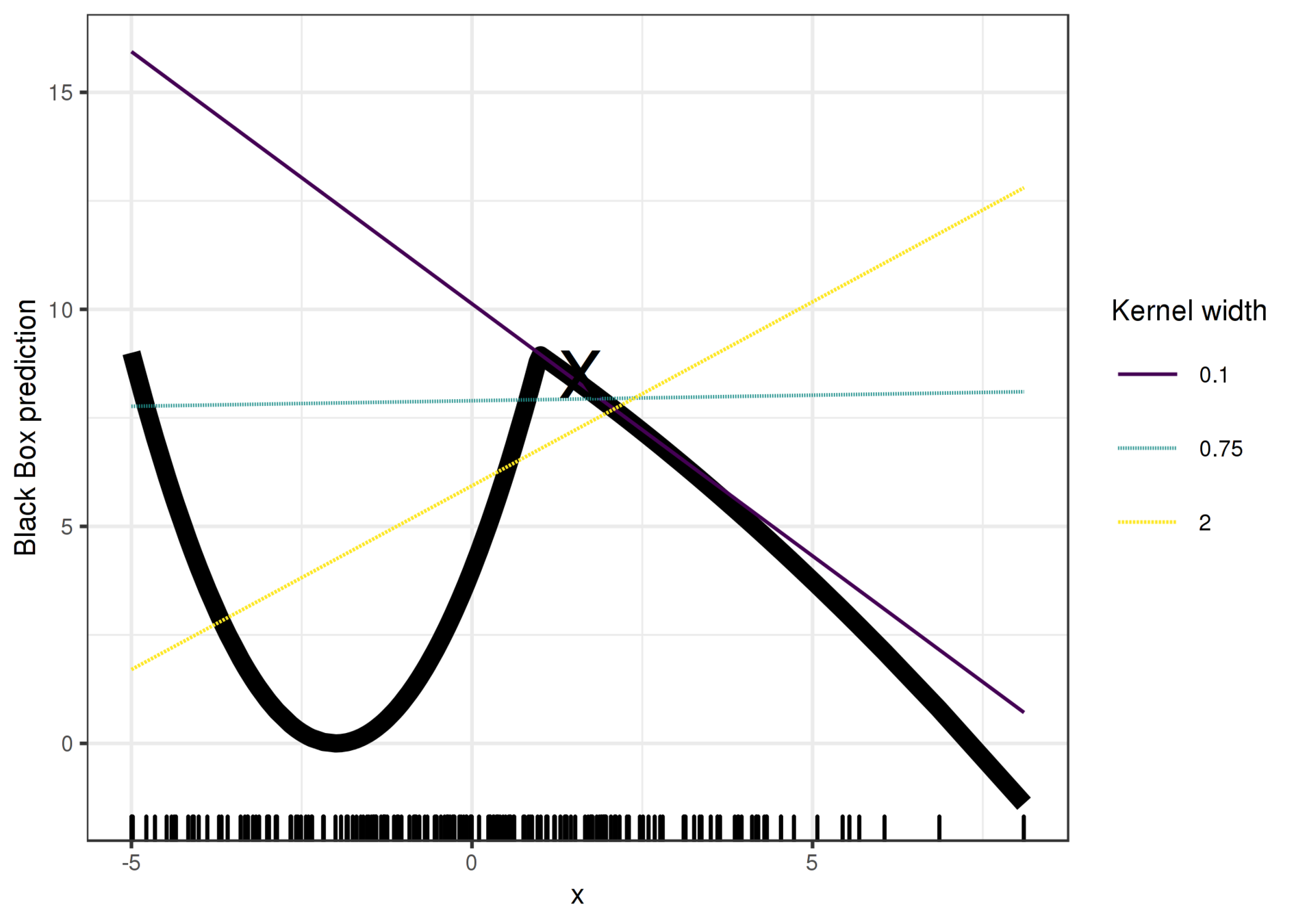

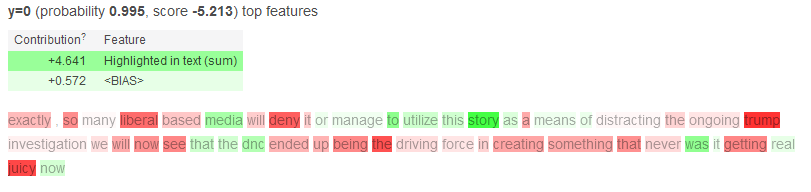

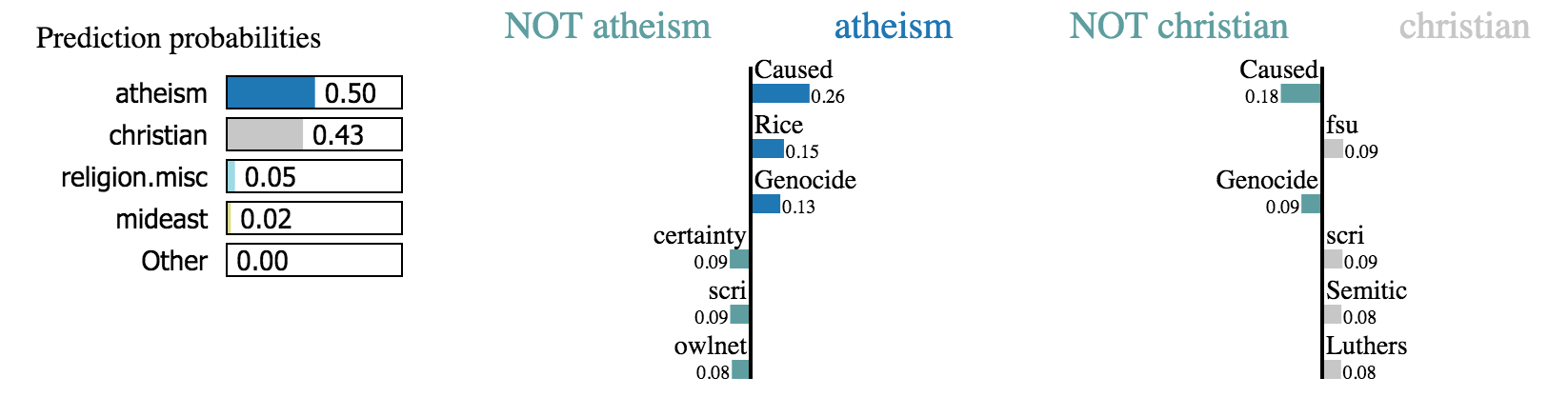

Model agnostic: LIME

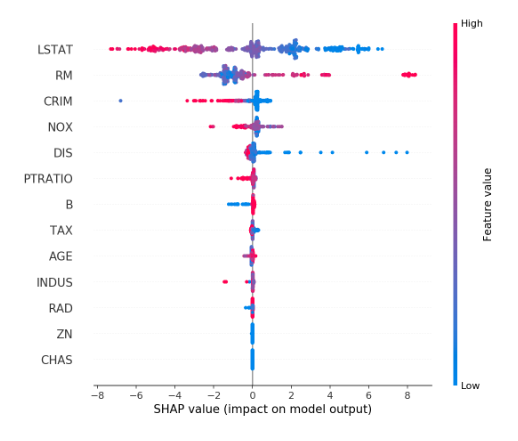

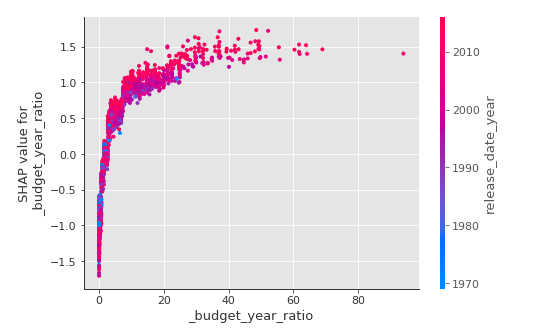

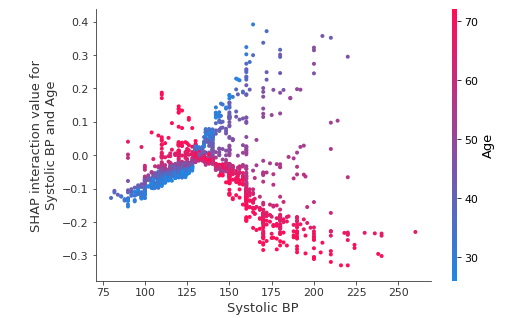

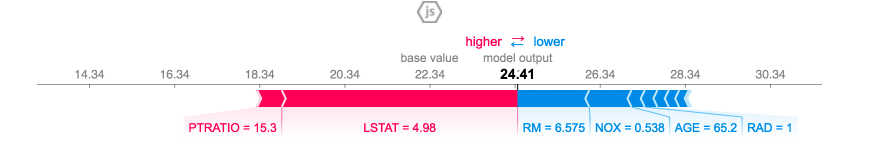

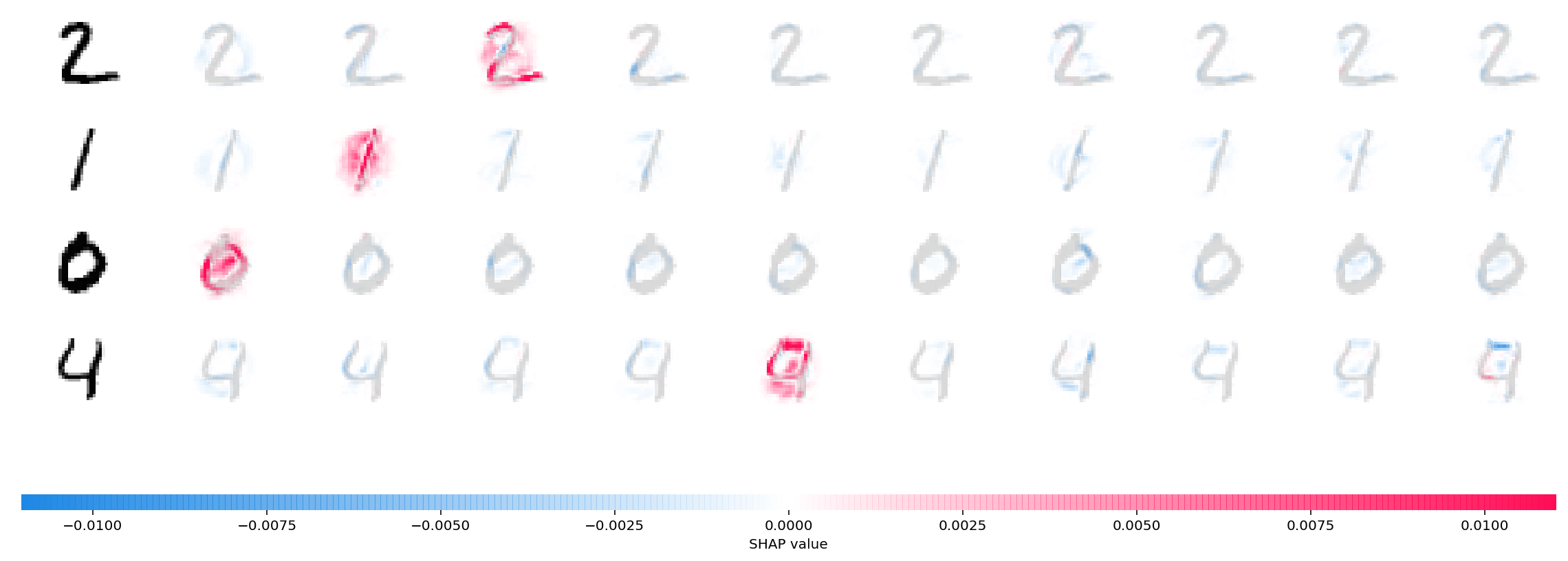

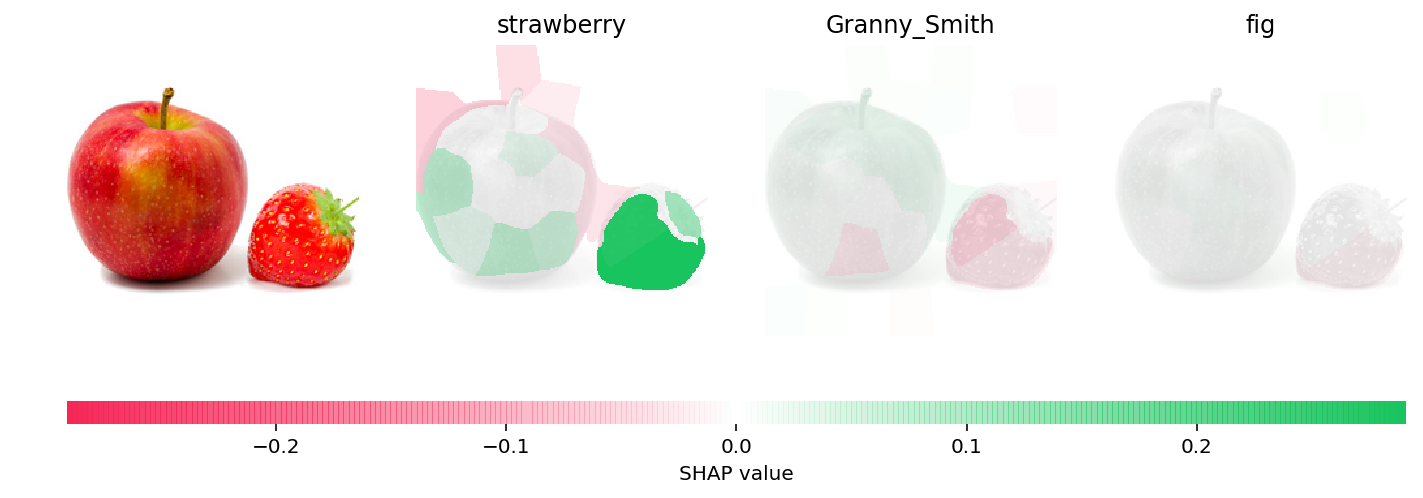

Model agnostic: Shapley

Model agnostic: Shapley

Model agnostic: Shapley

Sample level interpretation

Sample level interpretation

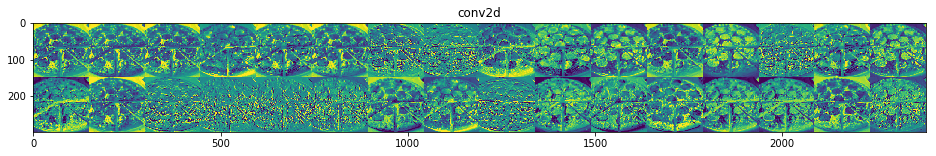

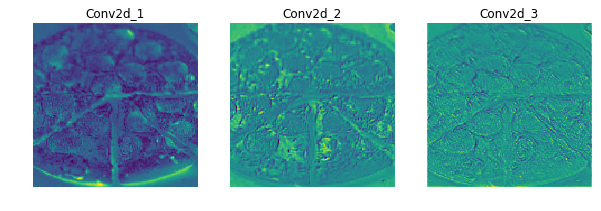

Bonus

Материалы

- https://christophm.github.io/interpretable-ml-book/

- https://www.youtube.com/watch?v=SOEPNYu6Yzc&t=9870s

- https://www.youtube.com/watch?v=FEg7JiubxLU

- https://www.oreilly.com/ideas/ideas-on-interpreting-machine-learning

- https://www.kaggle.com/theimgclist/multiclass-food-classification-using-tensorflow

- https://www.kaggle.com/artgor