1º Workshop de Integração da Pós-Graduação

Victor Sanches Portella

Maio, 2026

Pesquisa em Teoria do

Aprendizado de Máquina

Pesquisa Atualmente

Otimização para ML

Algoritmos Aleatorizados

Privacidade Diferencial

Online Learning

Ciência da Computação Teórica

Aprendizado de Máquina

Otimização para ML

Por que otimização de primeira ordem?

Treinar um modelo de ML normalmente é modelado via optimização irrestrita

Modelos de ML tendem a serem GRANDES

\(d\) é GRANDE

\(O(d)\) tempo e espaço por iteração é preferível

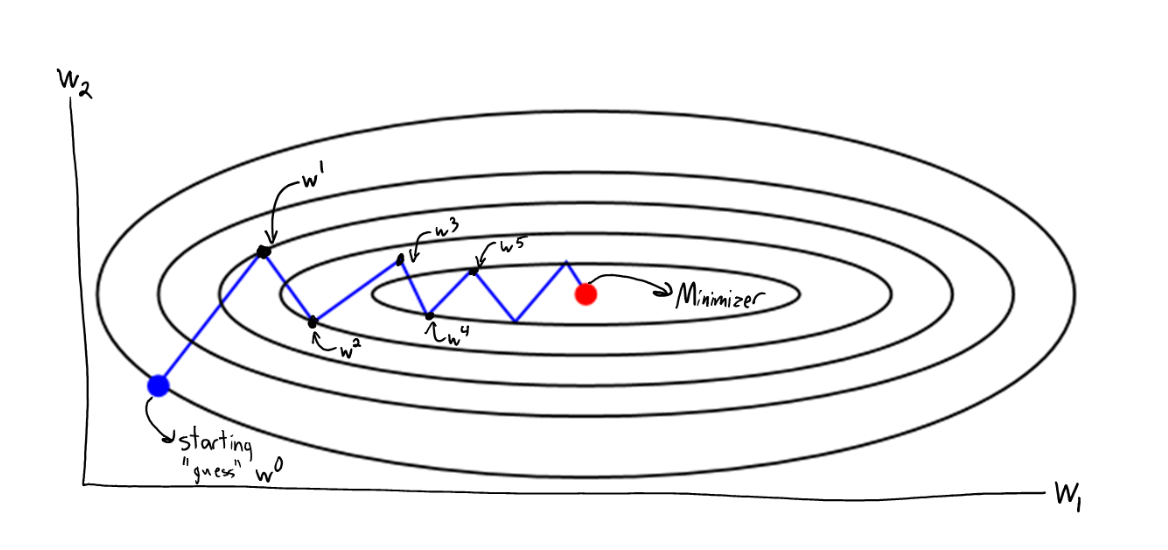

Algoritmo adaptativos em otimização

Um tamanho de passo "Adaptivo" para cada parâmetro

Uma definição formal de Online Learning (AdaGrad)

Hypergradient

Adam, RMSProp, RProp

Aprox. 2nd Order Methods

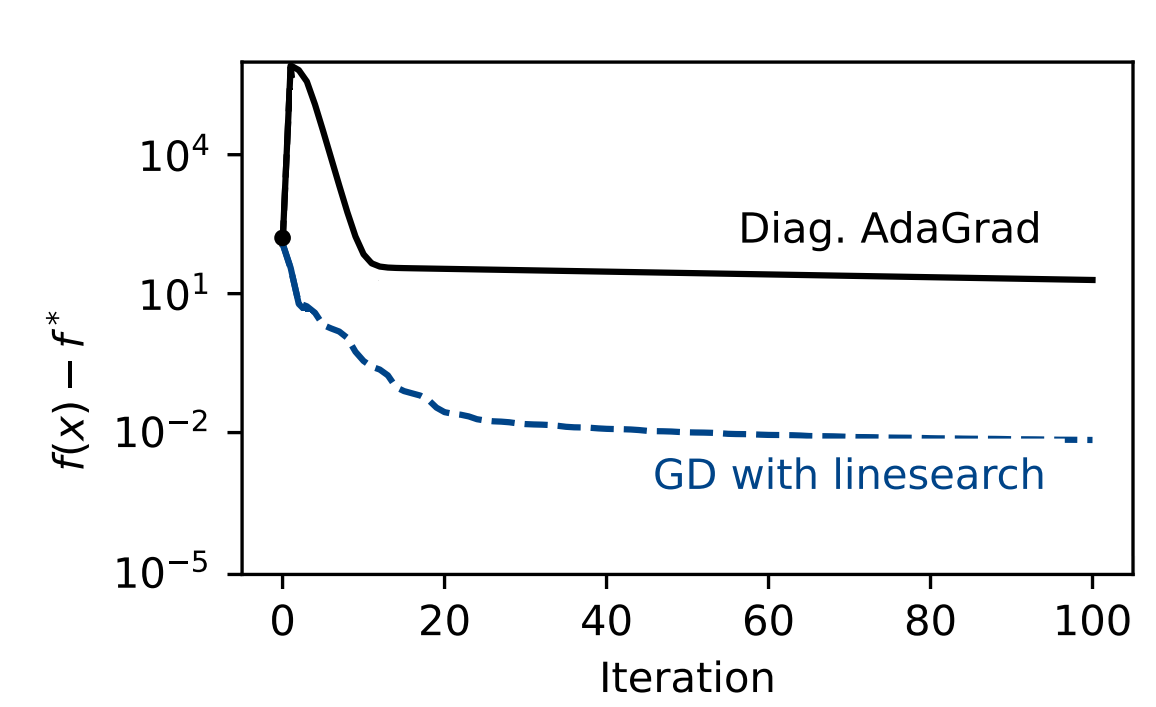

Desenhado para funções adversariais e não suave

Busca em linha clássica é melhor em problemas simples

Mas o que "adaptativo" significa?

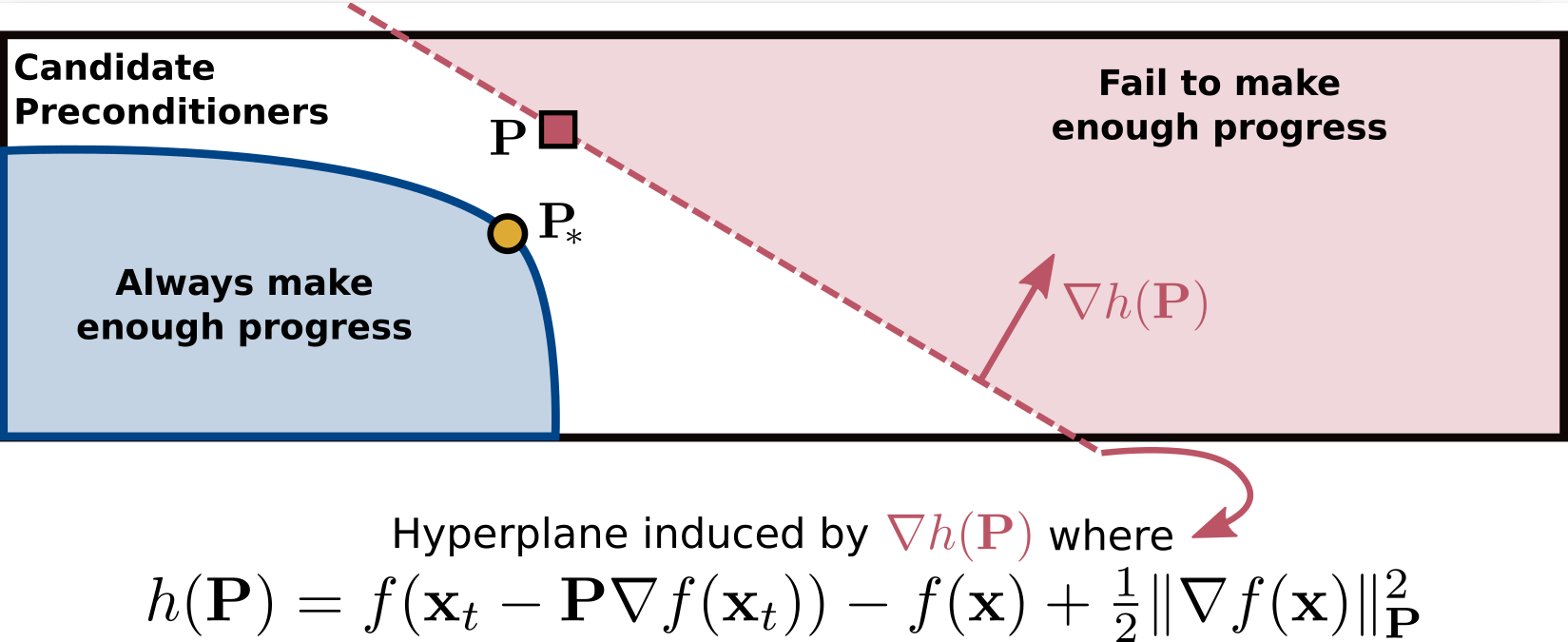

Definition of an Optimal Preconditioner

Adaptividade em problemas

suaves e

fortemente convexos

Multidimensional Backtracking

Ideia básica do algoritmo

A cada iteração

If

If

tem

progresso suficiente

Atualize \(\mathbf{x}\):

Else

Atualize \(\mathbf{P}\) e conjunto de passos candidatos

Busca de Precondicionador Diagonal

Aprendizado Online

Aprendizado Online com Experts

Jogador

Adversário

\(n\) Experts

0.5

0.1

0.3

0.1

Pesos

1

-1

0.5

-0.3

Custos

Penalidade do Jogador:

Adversário sabe a estratégia do Jogador

Performance medida

através de regret

Otimização adaptativa

Boosting

Bandits

Modelando Online Learning em Tempo Contínuo

Análise frequentemente limpa

Playground para design de algoritmos

Gradient flow útil para otimização suave

Pergunta Central: Como modelar optimization

não-suave (online) em tempo contínuo?

Por que usar ?

tempo contínuo

Custos Adversariais em Tempo Contínuo

Custo Total de um Expert \(i\):

Perspectiva útil: \(L(i)\) is a realização de um

passeio aleatório

realização de um

Movimento Browniano

Tempo Discreto

Tempo Contínuo

O Efeito da falta de suavidade

Lema de Ito

(Teorema Fundamental do Cálculo Estocástico)

\(B(t)\) muito não-suave \(\implies\) termos de segunda ordem importam

Ideia: Usar cálculo estocástico para guiar o design de algoritmos

Suave

Não-suave

Algoritmos Online Adaptativos

Otimização Linear Online

Quantile Regret

Privacidade Diferencial

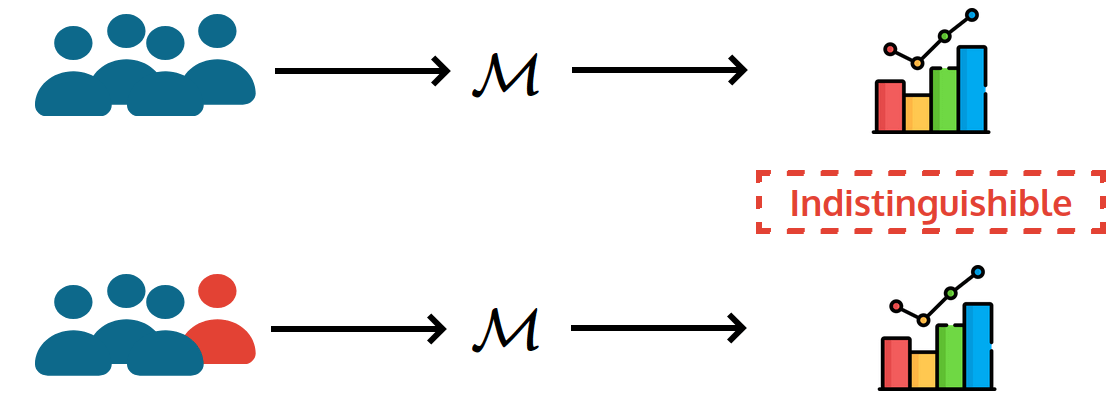

O que queremos dizer com "privacidade"?

Objetivo informal: Resultado não deve revelar (muito) sobre qualquer indivíduo em particular

Diferente de falhar de segurança (ex: invasão de servidor)

Resultado

Análise de Dados

Trivial se o resultado não tiver informação sobre a entrada

Privacidade Diferencial

Indistinguíveis

O que pode ser aprendido com um indivíduo

(provavelmente) pode ser aprendido sem o mesmo

Uma definição: Privacidade Diferencial

Algoritmos online em streams de dados

Um Problema:

Contar (aprox.) o número de elementos distintos em um stream de \(N\) itens de \(n\) tipos

Queremos usar espaço sublinear

Exemplo: Contador de número de ouvintes de uma música

Itens chegam sequencialmente

\(N\) e \(n\) são GRANDES

[Ícones de Pokemon por Roundicon Freebies em flaticon.com]

Revisitando Algoritmos de Streaming

Será que alguns algoritmos aletorizador possuem

garantias de privacidade sem modificações?

Normalmente, injetamos ruído/aleatoridade em algoritmos para conseguir garantias de PD

Mas muito algoritmos (online) são naturalmente aleatorizados!

LLMs e o Trabalho em Teoria

AI for Math

Hype e problemas com "IA"