Скованные одной цепью Маркова

Антон Антонов

Сегодня в программе:

реликтовое излучение

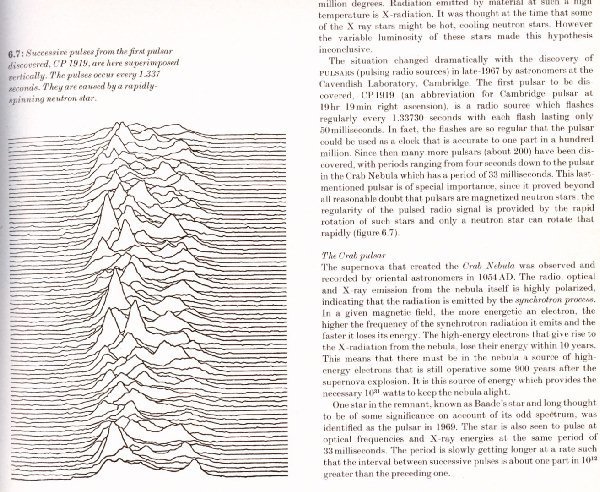

Harold D. Craft, Jr.

(PhD thesis, 1970)

Unknown Pleasures

(Joy Division, 1979)

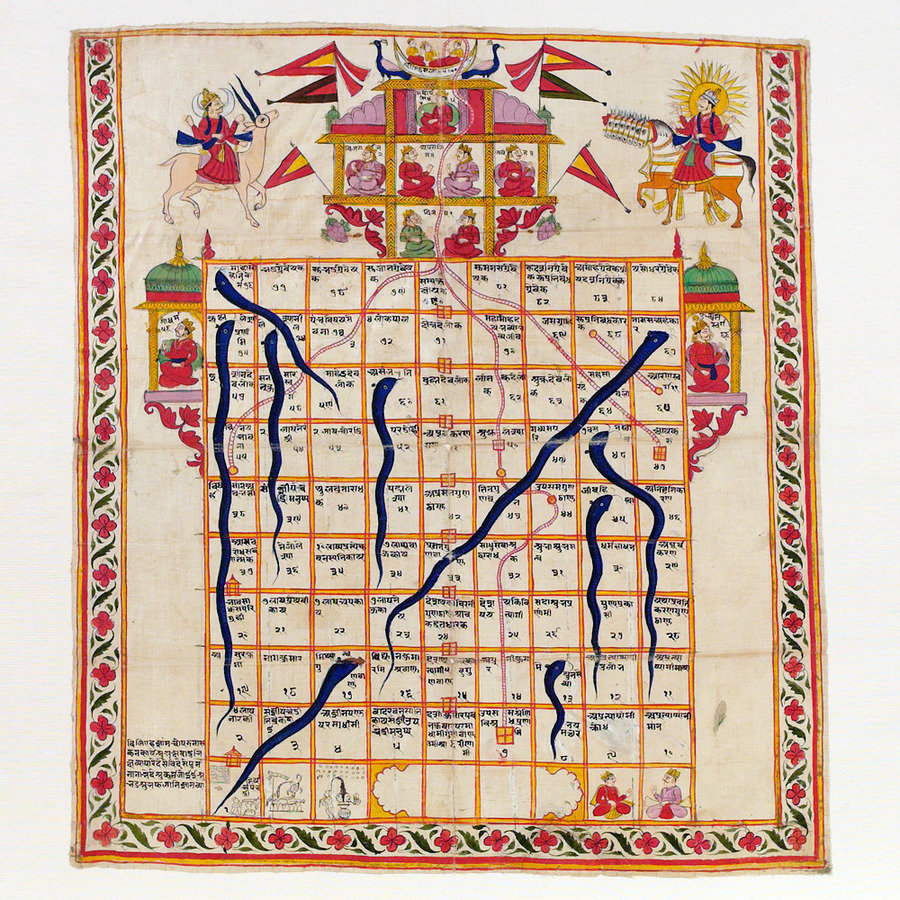

Snakes and ladders

Moksha Patam

2 век д.н.э.

13 век

«Ladders

And snakes

Ladders give

Snakes take

...»

- Вера

- Надёжность

- Щедрость

- Знание

- Аскетизм

- Непослушание

- Невежество

- Вульгарность

- Воровство

- Ложь

- Пьянство

- Долги

- Злоба

- Жадность

- Гордыня

- Убийство

- Похоть

Клетка #100:

- Дойдём ли мы когда-нибудь до конца?

- Сколько ходов в среднем для этого нужно?

- Насколько велико преимущество первого хода?

- ...

Марковская цепь

- (Конечный) набор состояний

- Дискретное время

- Набор вероятностей перехода между состояниями

- «Отсутствие памяти» : следующий шаг определяется только текущим состоянием

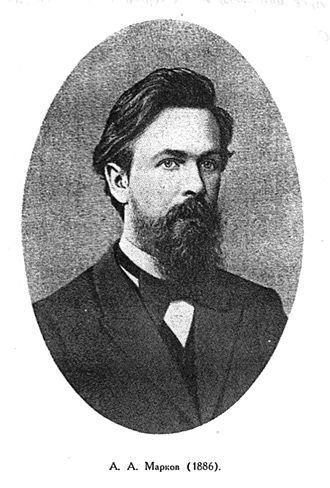

Андрей Андреевич Марков

1856-1922

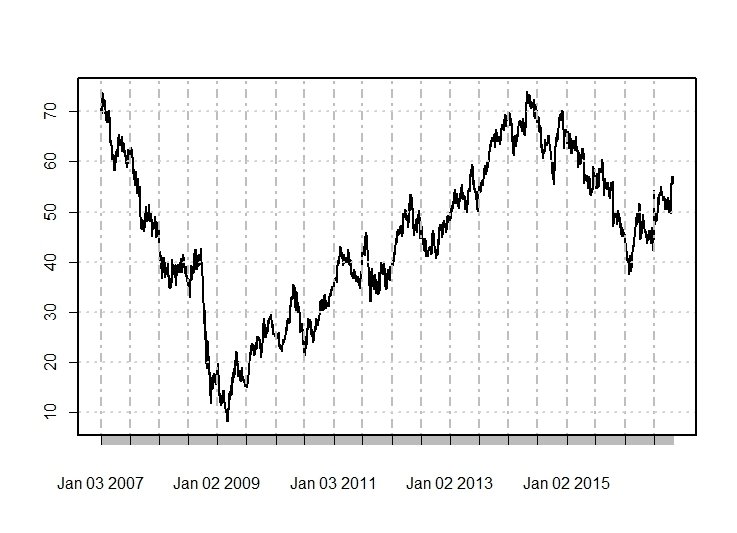

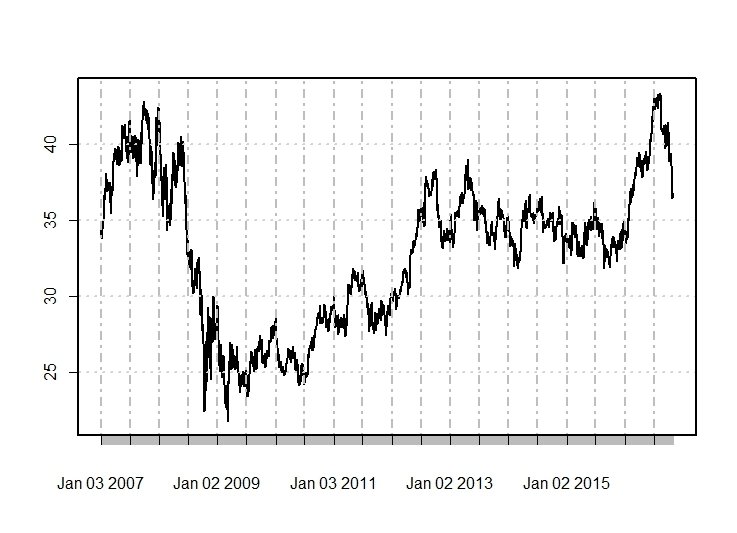

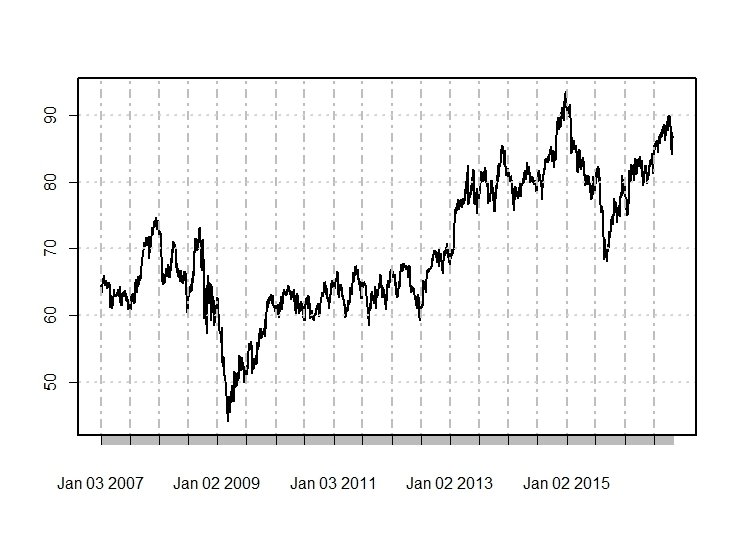

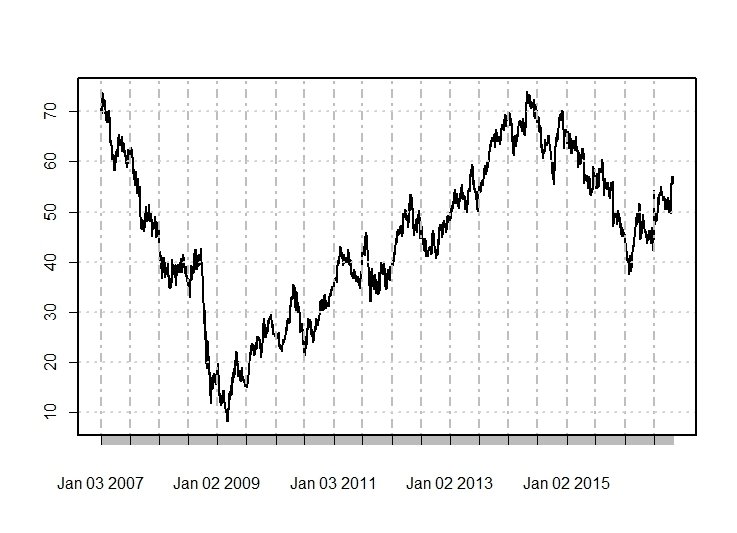

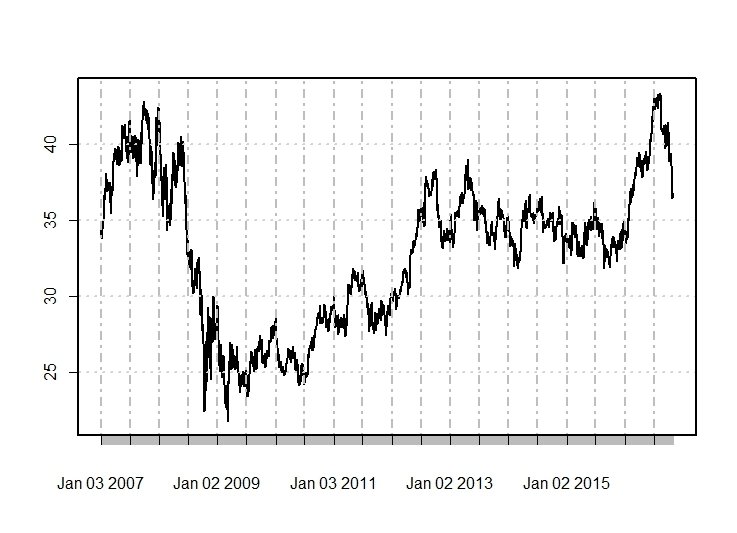

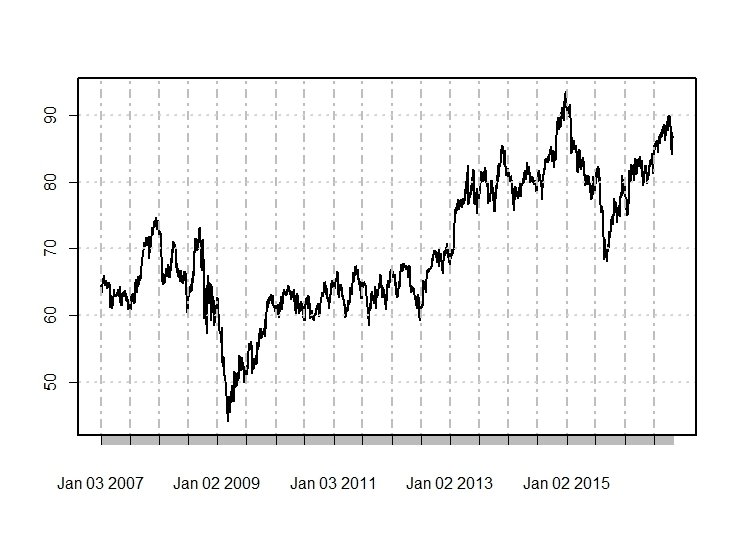

Рынок акций

Такая стабилизация означает,

что есть «эквилибриум»:

- Бесконечен ли цикл смены состояний?

- Зависит ли стационарное распределение от начального состояния цепи?

- Чему равна средняя продолжительность одного состояния?

стационарное распределение

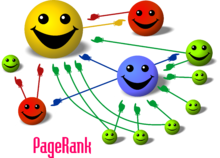

Применение цепей Маркова:

моделирование сложных систем

(химия, термодинамика, эконометрика)

системы массового обслуживания

алгоритм pagerank

скрытые марковские модели

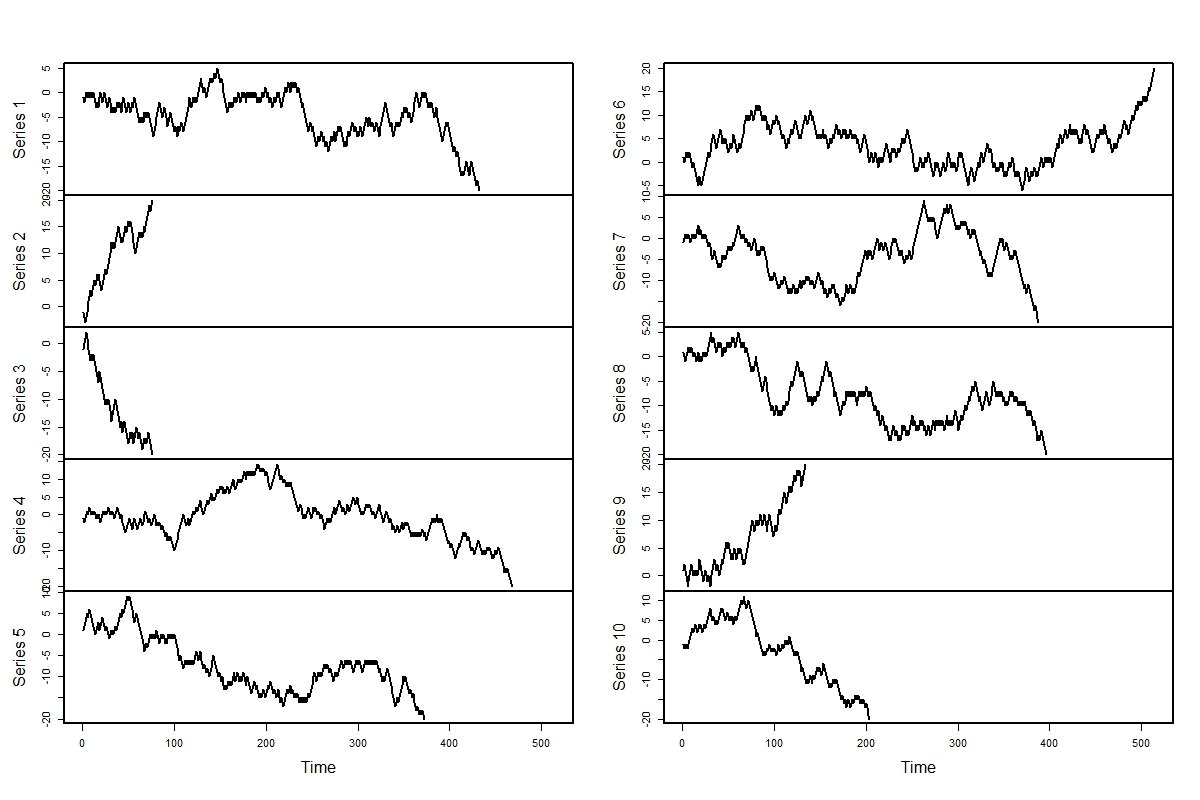

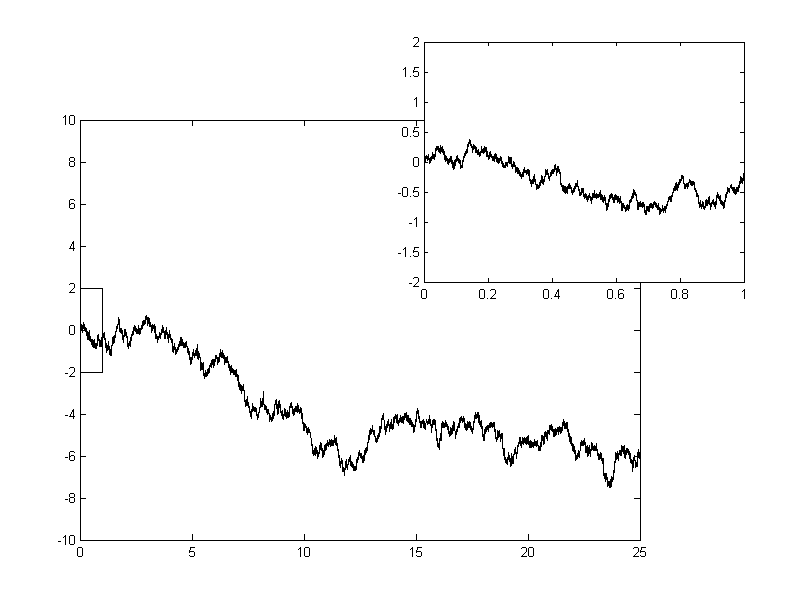

Одномерное случайное блуждание

Q: когда его ждать домой?

A: когда-нибудь, но ждать.

Gambler's ruin:

vs.

Винеровский процесс –

предел случайного блуждания

CC BY-SA 3.0, https://commons.wikimedia.org/w/index.php?curid=1426987

A

B

C

D

A

B

C

D

A

B

C

D

A

B

C

D

A

Cisco

Ford Motor

Urban Outfitters

C

Electronic Arts

Nike

Harley Davidson

D

Caterpillar

AT&T

Tiffany & Co.

C

Disney

Yahoo

Procter & Gamble

1. Играть против казино/букмекеров с целью заработать – плохая идея

2. Никто не может надежно прогнозировать краткосрочные изменения цен акций

3. Теория вероятностей применима даже к тем событиям, которые неслучайны по своей природе

Важные мысли

Скованные одной цепью Маркова

By Antonov Anton

Скованные одной цепью Маркова

The talk I gave at Ycamp, an interdisciplinary event for scientists, entrepreneurs and industry professionals (http://www.ycamp.ru/http://www.ycamp.ru/http://www.ycamp.ru/

- 1,509