Introduction

Data & IA responsable

Nicolas Rochet

Juin 2025

Comment les utiliser de manière éthique ?

Qui suis je ?

Data for Good

Data & IA responsable

Connectez vous pour participer

https://app.wooclap.com/UOFMTG

Quels mots cela vous évoque ?

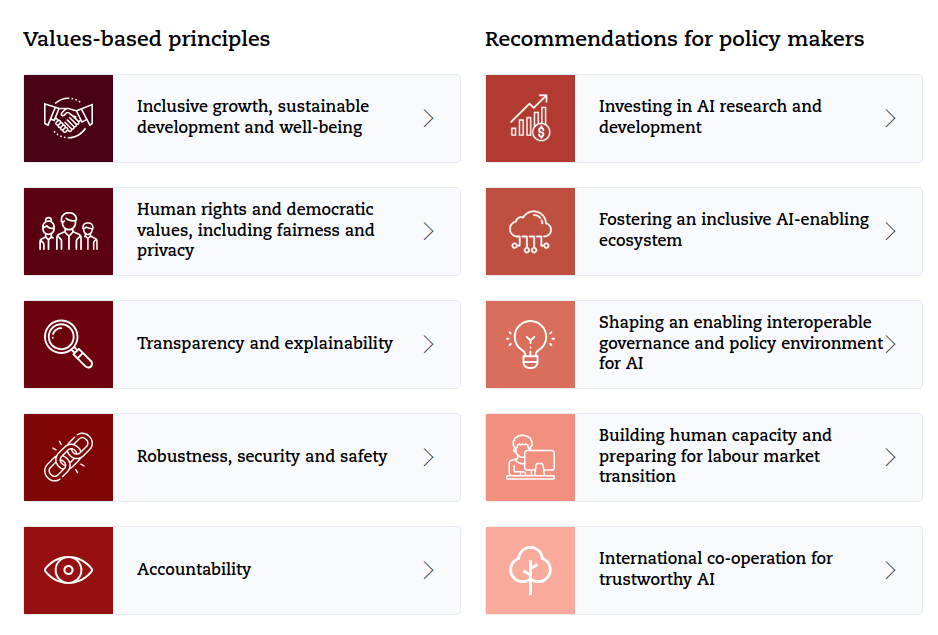

Les principes majeurs

Privacy

Methodology & code transparency

Model's interpretability

Storage & training

Impact on users

Bias in data

IA Frugale

IA transparente

IA équitable

IA expliquable

Accessible Data

Ecological footprint

Inference for a mass of users

Bias in models

Impacts de la data & l'IA

Ou mettre la balance ?

Un exercice : evaluer l'impact de l'IA

Société

Organisations

Individus

Nuisance écologique

Suppression d'emplois

Induire ou renforcer des inégalités

Invasion de la

vie privée

risques

progrès

Faible prise de conscience

Risque de

dépendance technologique

Amélioration des

conditions de travail

Amélioration du niveau de vie

Assistance de l'humain

Résoudre des problèmes systémiques

Accompagner les progrès de la science

Problèmes éthiques

Experience : que voyez vous?

Une perturbation a été appliquée à l'image pour manipuler votre perception

Utilisation des données personnelles

Scandales

Mises en évidence

Beaucoup de services d'IA exploitent vos données personnelles !

Si c'est gratuit c'est toi le produit

Vente de données personnelles

Cyber attaques et fuites de données

plateformes d'IA génératives

Logiciels de messagerie

Réseaux sociaux

Plateformes de streaming

...

voir les Conditions d'utilisations des services !

... et impact sur la société

Manipulation of public opinion

Enfermement par les algorithmes de recommandation

Faux comptes

Fake news

dérégulation des systèmes de modération

Polarisation des opinions sur internet

Révélation d'espionnage de masse

Désinformation

Opacité des services d'IA

Lorsque les décisions sociétales sont basées sur des algorithmes qui ne sont pas ouverts / compréhensibles

Usage d'algorithmes pour la Police Predictive (US)

Usage d'algorithmes pour prédire la récidive

Usage d'algorithmes pour classer les clients

Usage d'algorithms pour classer les profs (US)

...

En France : Plainte sur l'opacité de Parcours sup

Some fields of application migth requires stronger standart

Applications of AI in health

Autonomous driving

rules

Public services

...

Transparency & Interpretability

Insurance & banking

Large Langage Model

& chatbots

Limitations dues au Machine Learning

Les algorithmes de ML sont statistiques : ils font toujours des erreurs !

Leur résultats peuvent être biaisés par les données ou modèles

La plupart des modèles sont des boites noires difficiles à interpréter

...

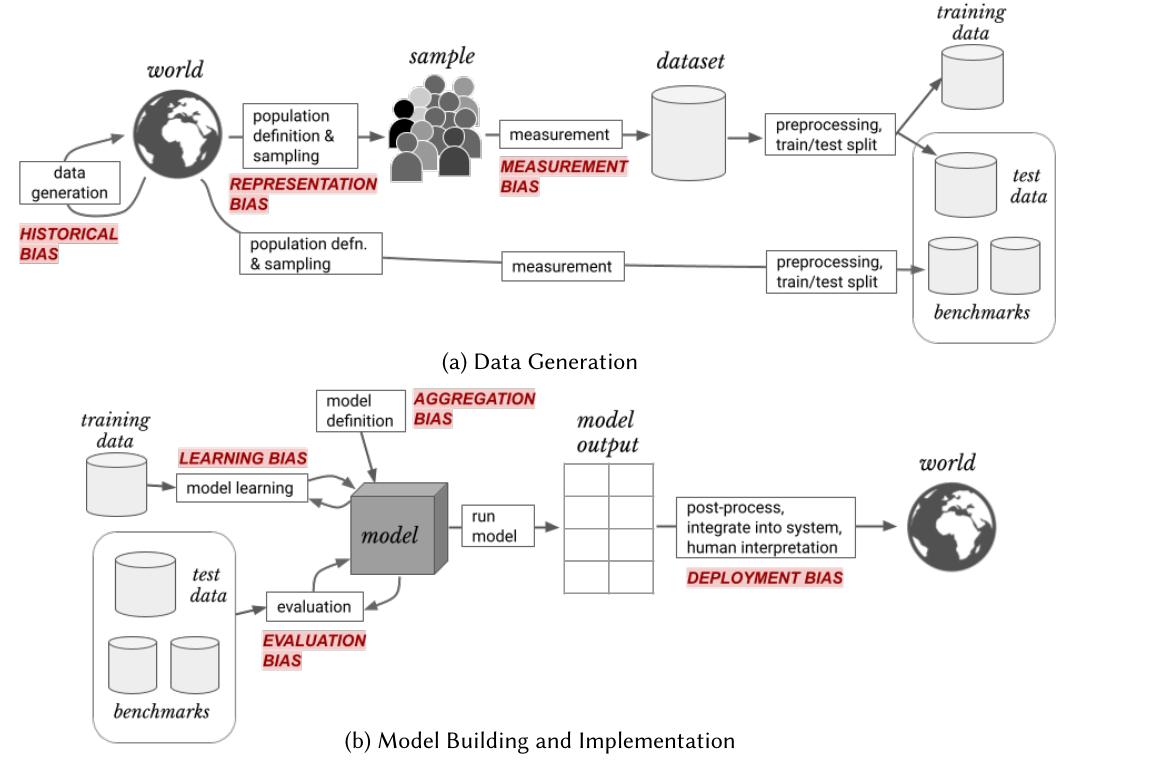

Les biais sont presents dans tout le cycle de vie !

from kaggle

Bias

Ces IAs sont particulièrement touchées

from kaggle

Biais & IA génératives

Biais ethniques

Biais de genres

Contenu haineux

Amplification de stérotypes

...

elles sont entrainés très longuement sur des jeux de données gigantesques ...

Stockage

IoT

Empreinte écologique

Calcul algorithmiques

Big Data

Data centers

Entrainement des IA

internet : appels aux APIs

Réseaux

5G

ordinateurs

téléphones

Equipements

Une grande quantité de donnée !

environ 3 à 4 % de l'empreinte mondiale ! et cela va augmenter

serveurs

Inférence (utilisation)

Données générées

ecrans

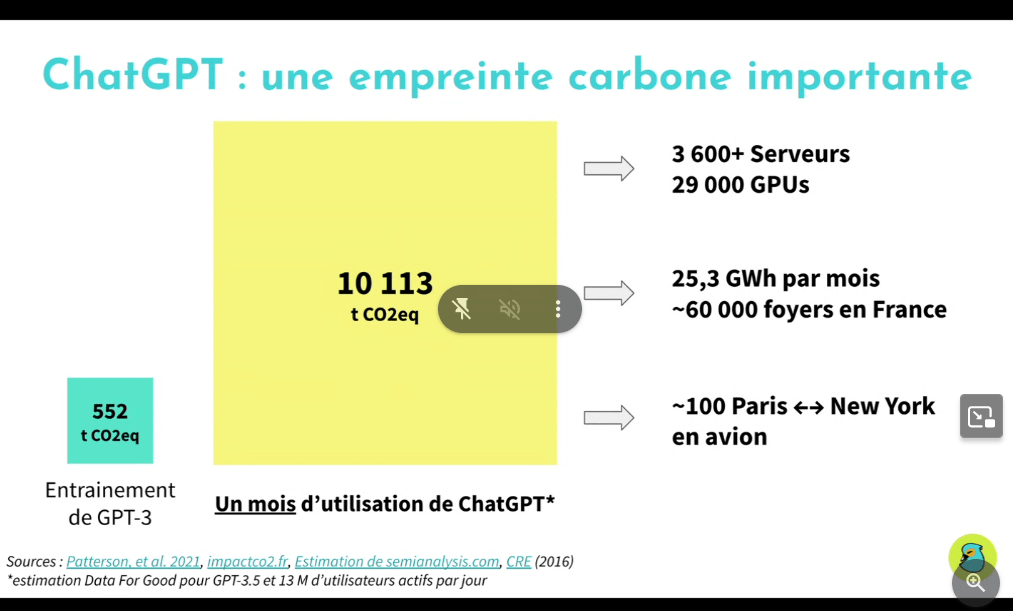

Empreinte écologique

Pour l'entrainement Large Langage Models

370 BMW

Consommation annuelle du Danemark !

L'usage massif de l'IA génerative

coût pour GPT-3 : des millions de $

120 foyers américains pendant 1 an

L'usage massif de l'IA génerative

Empreinte écologique

L'essentiel de l'empreinte vient de l'usage !

Interagir avec 25 prompts

0.5 L

Ou est l'équilibre ?

Problèmes dus à l'IA

Bénéfices apportés par l'IA

Implications sociétale

Legale

Professionnelle

Environmentale

Informationnelle

...

Sociale

Intitiatives

Manifestes

Depuis Novembre 2017

Manifestes & chartes

...

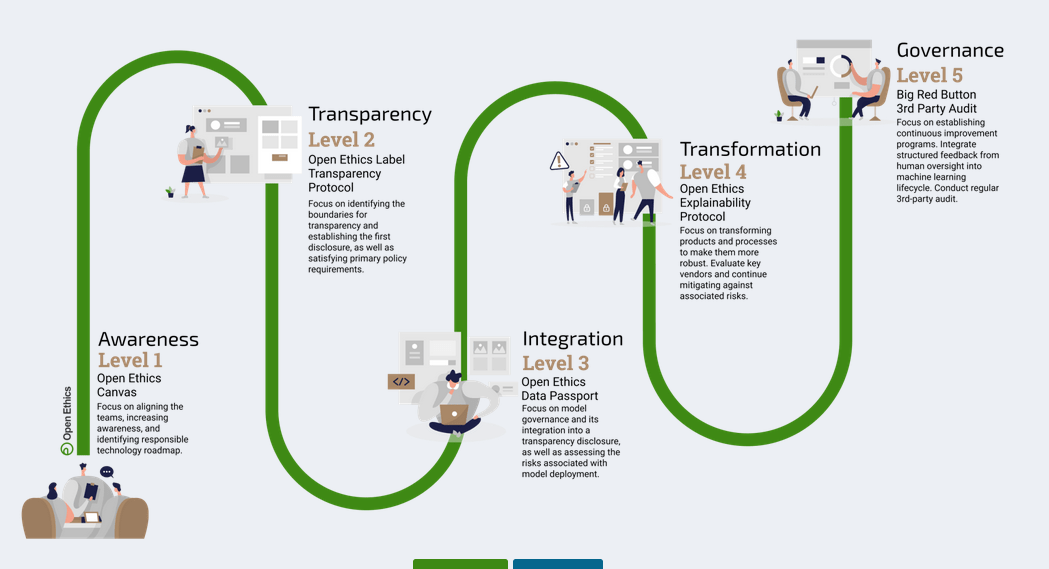

Méthodes & frameworks

Propose un méthode pour implémenter l'IA responsable dans les organisations

Recommandations pratiques

Exemple

Règlements

en application depuis mai 2018 !

Des régulations se développent également par pays

les systèmes d'IA sont classifiés suivant 4 niveaux de risques pour les utilisateurs

applicable in 2025

Inacceptable

Elevé

Limité

Minimal

IAs considérée comme une menace pour les personnes

impact négatif limité sur la vie des personnes

8 domaines sensibles identifés

Certaines applications de l'IA gen

IA qui devront satifsfaire à des exigences de transparence

devront être enregistrée sur le portail de l'UE

services en ligne, assistant vocaux, etc ...

IA de jeux vidéos, anti-spam, ...

manipulation sociale

classement social

AI Act : 4 niveaux de risques

pas d'impact significatif sur les persionne

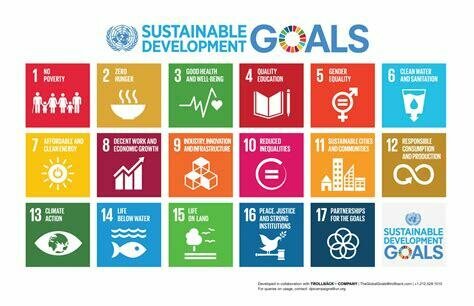

Des guides sociétaux

17 Objectifs de développement durables

Qui peut jouer un rôle ?

Acteurs

Labels

Entreprises & concepteurs

Laboratoires

Comité d'éthique

hackathons

Citoyens

Organisations Publiques

Clients

Utilisateurs

Chartes

Réglementations

Gouvernements

Décideurs

workshops

Diminuer l'empreinte de l'AI

Rendre les modèles plus expliquables, equitables

Think tanks

Rapports

Manifestes

Adopter des pratriques d'ethique-by-design

Recherche & Entreprise tech

...

IA frugale

IA expliquable

IA équitable

Constuire des modèles plus expliquables

Diminuer l'empreinte des modèles d'IA

Assurer la protection des données

Mesurer l'impact sur les utilisateurs

Minimiser les biais

IA transparente

Entrainer les modèles sur des données ouvertes

Utilisateurs

...

IA transparente

Privilégier des modèles ouverts

Falcon

Claude

Llama 3

Le chat Mistral

Exemple d'IA génératives ouvertes

Deep Seek

Utilisateurs

...

IA frugale

Choisir des modèles moins énergivores

A performance acceptable, privilégier un modèle plus petit

On rencontre souvent 3 tailles de Large Langage Models

Moyen

Grand

> 100b

10b - 15b

Capacité croissante

Petit

1.5b - 5b

Utilisateurs

...

IA frugale

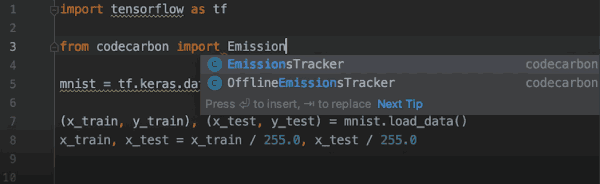

Mesurer la performance et l'impact des IAs génératives

A performance acceptable, privilégier un modèle plus petit

Pour les data scientists

...

Gestion des données personnelles

Nécessité de faire mieux que l'anonymisation de données

Quelques solutions

Zama framework pour le ML homomorphique : travailler sur des données chiffrées

...

Outils pour rendre les modèles d'IA plus expliquable

Pour les data scientists

Pour les data scientists

Auditer les modèles d'IA

Utiliser des licences d'IA responsable

Une licence pour les services d'IA responsables

Mesurer l'empreinte énergétique

Mesurer l'empreinte de son code

Mesurer l'empreinte de l'usage de LLMs

Pour les data scientists

API pour mesurer l'empreinte du numérique

Public organisations

...

my prefered ones

Wikipedia

Enjeux

Challenges

Nécessité de continuer à faire avancer l'adoption de l'IA l'éthique

Augmenter l'appliction des réglements & bonnes pratiques

Encourager les changements d'habitude

Recommandations

S'informer et garder un esprit critique

Se questionner sur son besoin : ai-je absolument besoin d'IA ?

Lire le CGU des outils que l'on utilise

Privilégier des outils open source

Privilégier des modèles d'IA frugaux

Boycotter certains services d'IA peu éthiques ?

En tant qu'utilisateur on a quand même un pouvoir

Merci pour votre attention !

Des questions ?

Data & IA éthique et responsable

By Nicolas Rochet

Data & IA éthique et responsable

cours d'introduction à l'éthique appliquée de l'IA

- 75