[1]

Seminarium Specjalnościowe

Rozpoznawanie gestów z wykorzystaniem kontrolera Leap Motion

algorytmy i badania eksperymentalne

Autor

inż. Krzysztof Wolski

Programista Python, JS, C#

Zainteresowania:

- Zastosowania informatyki w medycynie

- UX

- webdev

- gamedev

Konspekt

- Temat pracy

- Harmonogram

- Postępy

- Prognoza

Temat

Prowadzący

Rozpoznawanie gestów z wykorzystaniem kontrolera Leap Motion - algorytmy i badania eksperymentalne

prof. dr hab. inż. Marek Kurzyński

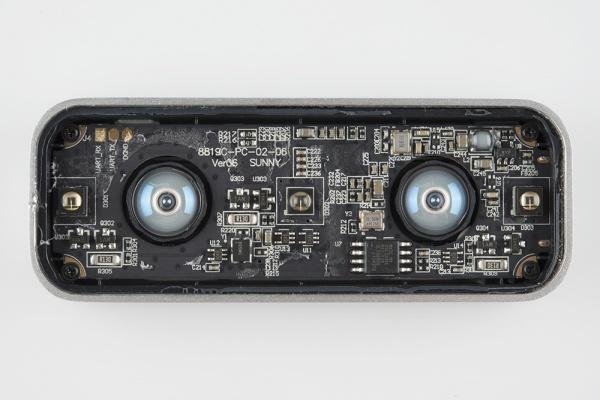

Leap Motion

Niewielkie urządzenie przechwytujące ruchy dłoni

Interfejs USB

Stereoskopia z kamerami IR

Prawie 300 kl/s

API dla C++, C#, Python, Java

[1][2]

[3]

Harmonogram

-

listopad - grudzień 2014

- ustalenie szczegółów tematu

- zgromadzenie literatury

- rozpoczęcie prac nad aplikacją

-

styczeń 2015

- zebranie danych doświadczalnych

- pierwsze prototypy aplikacji

-

luty - kwiecień 2015

- rozwijanie funkcjonalności aplikacji

-

kwiecień - maj 2015

- eksperymenty

- dokumentacja badań

Problem: Unity + AForge

- Unity wykorzystuje Mono

- Błędy przy integracji z dostępną wersją Unity

Rozwiązanie: Python

- API LeapMotion działa z Pythonem

- Zmiana AForge na PyBrain

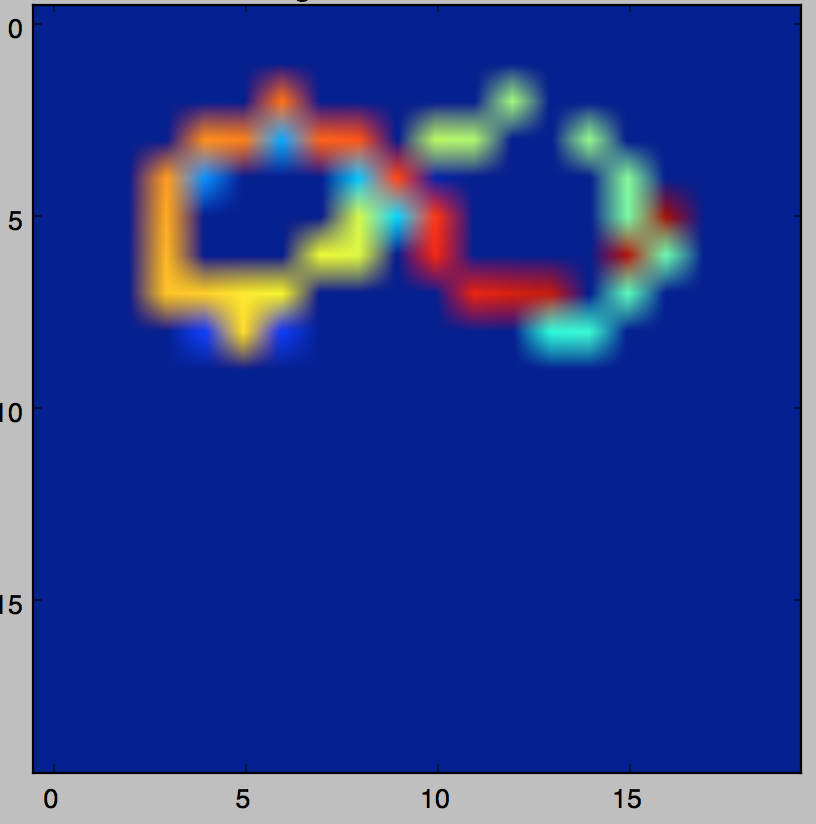

- Prezentacja danych w Matplotlib

Konsekwencje

- Trudniejsza optymalizacja

- Brak wizualizacji 3D

Problem: Rodzaj gestów

- ASL + Leap Motion = pudło

- Motion Savvy chyba się przeliczyło

- Alfabet ASL = pudło

Rozwiązanie: Pozycja zamiast poza dłoni

- Pewniejszy odczyt

- Wykonanie gestu rozpoczyna rozpoznawanie

- Mniej błędów rozpoznania

Zagadnienia

- Biblioteka Theano

- CNN - Convolutional Neural Networks

- Deep Learning

- Obliczenia GPU

- Zwiększenie zbioru treningowego

Prognozy?

Wszystko będzie dobrze.

Źródła

https://www.leapmotion.com/product/

https://learn.sparkfun.com/tutorials/leap-motion-teardown

http://www.motionsavvy.com/

Dziękuję za uwagę

Seminarium Specjalnościowe 4

By Krzysztof Wolski

Seminarium Specjalnościowe 4

- 640