PRINCÍPIOS E TÉCNICAS DE ELETROENCEFALOGRAFIA EM NEUROCIÊNCIA

AULA 07 - Teoria da Informação: O Teorema de Shannon (parte I)

Instituto de Ciência e Tecnologia

Graduação em Engenharia Biomédica

Prof. Dr. Adenauer G. Casali

Laboratório de Neuroengenharia e Computação

casali@unifesp.br

PRINCÍPIOS E TÉCNICAS DE EEG EM NEUROCIÊNCIA

- Informação neural

- Claude Shannon e o conceito de Informação como redução de incerteza

- Preparação para o teorema de Shannon: ensemble, sequências e compressão

- O conjunto das Sequencias Típicas

Adenauer G. CASALI

AULA 07

Nesta aula, nós veremos...

1. Informação Neural

Princípios e Técnicas de EEG

Aula 07

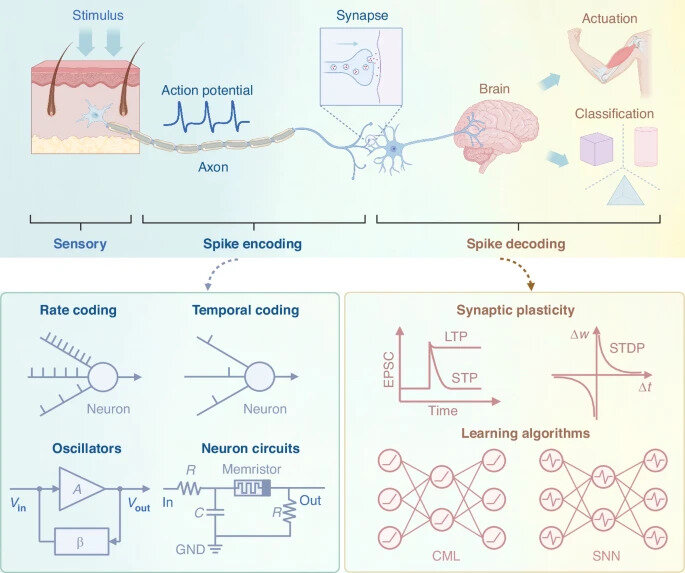

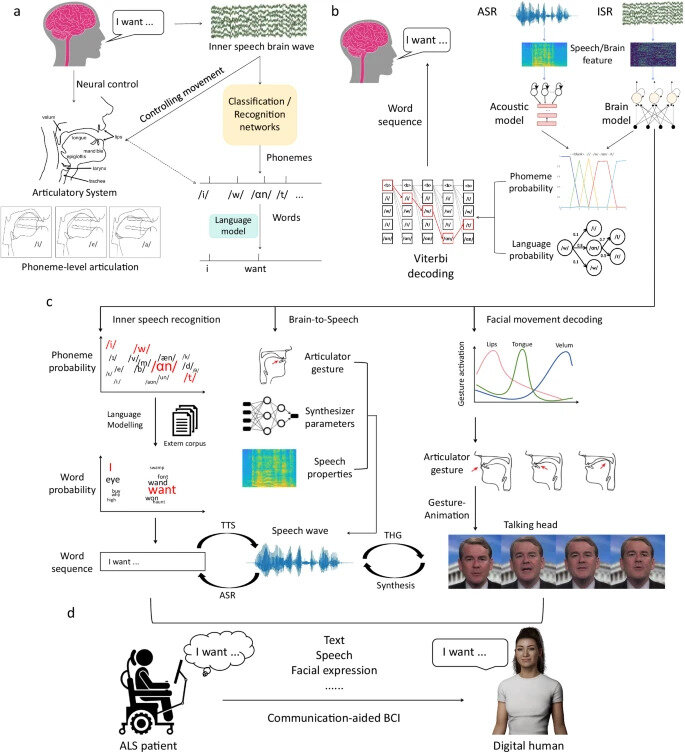

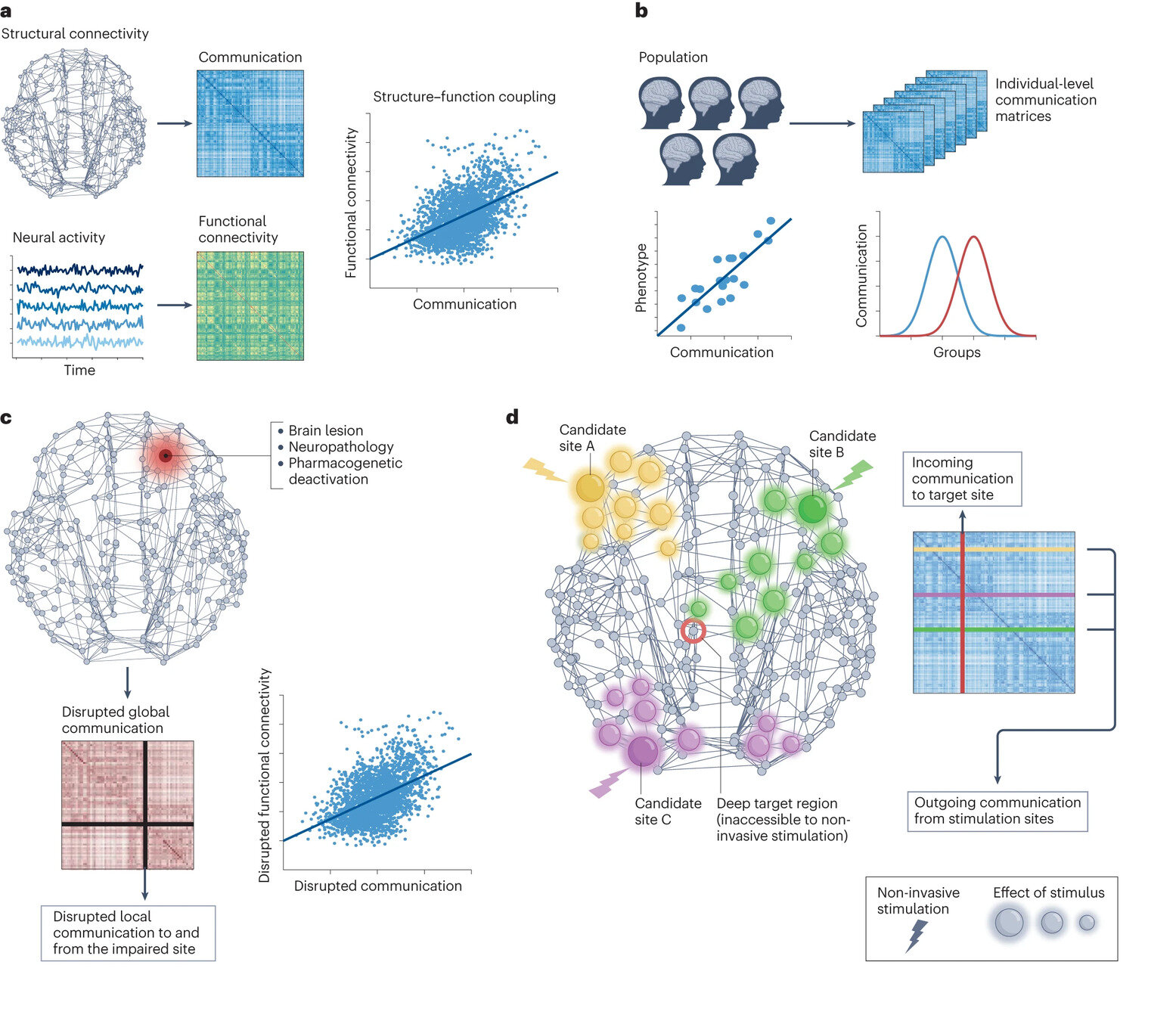

Fonte: Zhu et al. (2025)

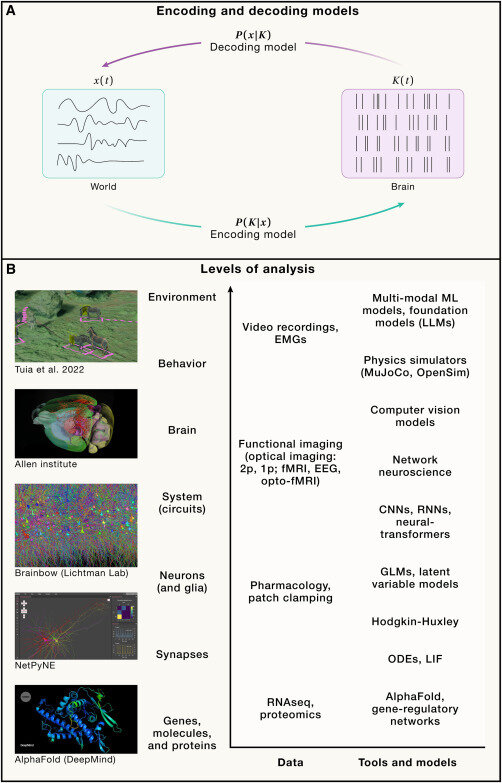

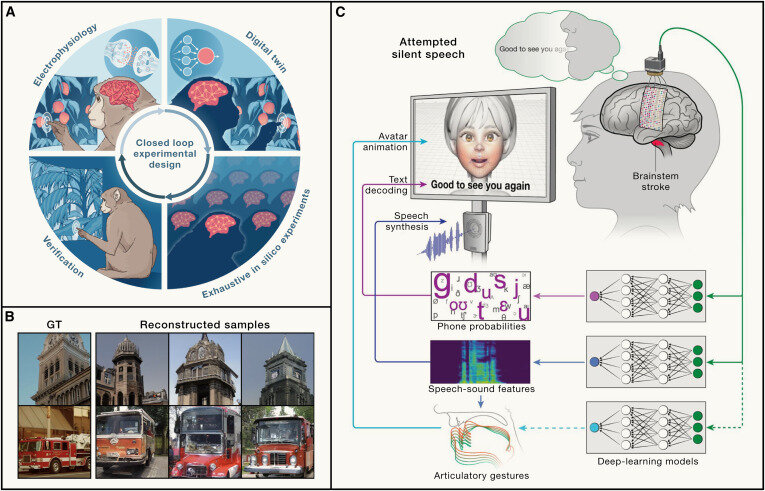

Fonte: Mattis et al., (2024)

1. Informação Neural

Princípios e Técnicas de EEG

Aula 07

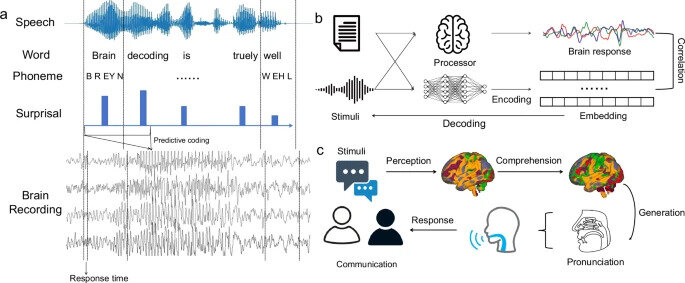

"Speech Neuroprosthesis"

1. Informação Neural

Princípios e Técnicas de EEG

Aula 07

Fonte: Mattis et al., (2024)

Mas o que é "Informação" exatamente?

Princípios e Técnicas de EEG

Aula 07

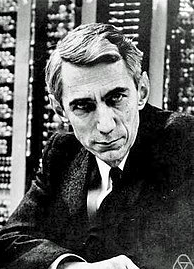

Claude Shannon

(1916-2001)

Fonte: Shannon, C. (1948)

2. Claude Shannon e o conceito de Informação

Princípios e Técnicas de EEG

Aula 07

Claude Shannon

(1916-2001)

"A basic idea in information theory is that information can be treated very much like a physical quantity, such as mass or energy."

3. Preparação para o Teorema de Shannon

Princípios e Técnicas de EEG

Aula 07

3. Preparação para o Teorema de Shannon

Princípios e Técnicas de EEG

Aula 07

3. Preparação para o Teorema de Shannon

Princípios e Técnicas de EEG

Aula 07

3. Preparação para o Teorema de Shannon

Princípios e Técnicas de EEG

Aula 07

3. Preparação para o Teorema de Shannon

Princípios e Técnicas de EEG

Aula 07

4. Sequências Típicas

Princípios e Técnicas de EEG

Aula 07

4. Sequências Típicas

Princípios e Técnicas de EEG

Aula 07

4. Sequências Típicas

Princípios e Técnicas de EEG

Aula 07

4. Sequências Típicas

Princípios e Técnicas de EEG

Aula 07

Continua na próxima aula...

4. Sequências Típicas

PRINCÍPIOS E TÉCNICAS DE ELETROENCEFALOGRAFIA EM NEUROCIÊNCIA

Próximas Aulas:

AULA 08 - Pré-processamento do EEG (parte I)

AULA 09 (Tópicos Avançados) - O Teorema de Shannon - parte II

Instituto de Ciência e Tecnologia

Graduação em Engenharia Biomédica

Prof. Dr. Adenauer G. Casali

Laboratório de Neuroengenharia e Computação

casali@unifesp.br

Tópicos Avançados - Aula 07 - Teoria da Informação: O Teorema de Shannon (parte I)

By ADENAUER GIRARDI CASALI

Tópicos Avançados - Aula 07 - Teoria da Informação: O Teorema de Shannon (parte I)

- 21