PRINCÍPIOS E TÉCNICAS DE ELETROENCEFALOGRAFIA EM NEUROCIÊNCIA

AULA 12 - Como estimar entropia na prática?

Instituto de Ciência e Tecnologia

Graduação em Engenharia Biomédica

Prof. Dr. Adenauer G. Casali

Laboratório de Neuroengenharia e Computação

casali@unifesp.br

PRINCÍPIOS E TÉCNICAS DE EEG EM NEUROCIÊNCIA

Como estimar entropia e informação na prática?

1. binning,

2. kDE (e dilema viés x variância)

3. k-NN

4. GCMI

Adenauer G. CASALI

AULA 12

Nesta aula, nós veremos...

1. Como estimar H e MI na prática?

Princípios e Técnicas de EEG

Aula 12

?

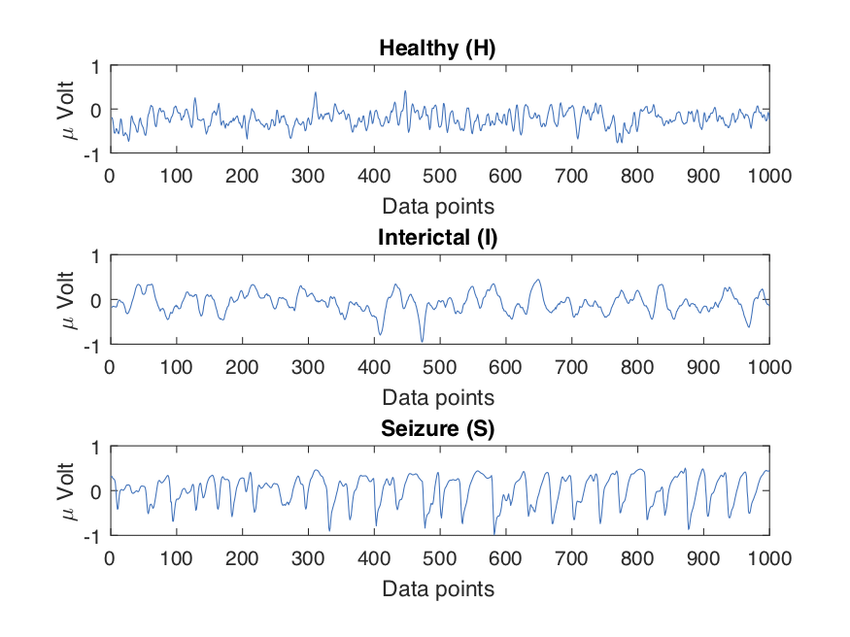

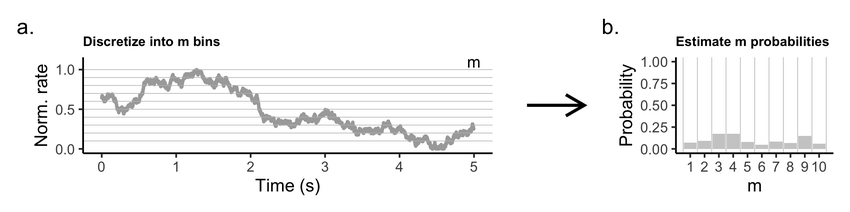

Fonte: Peterson and Voytek (2021)

1.Histogramas

Princípios e Técnicas de EEG

Aula 12

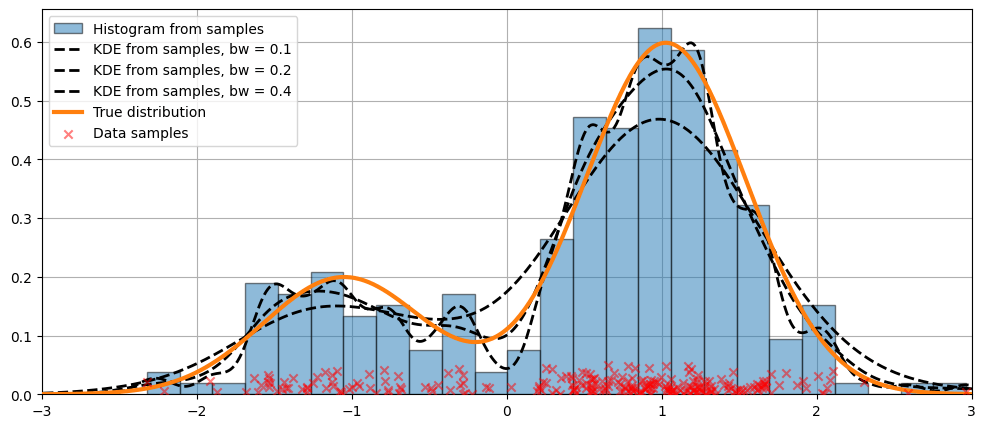

Que tal estimar a entropia sem discretizar?

Princípios e Técnicas de EEG

Aula 12

1.Histogramas

Fonte: statsmodel

Princípios e Técnicas de EEG

Aula 12

2.KDE

Princípios e Técnicas de EEG

Aula 12

2.KDE

Princípios e Técnicas de EEG

Aula 12

2.KDE

Princípios e Técnicas de EEG

Aula 12

2.KDE

1

0

Princípios e Técnicas de EEG

Aula 12

2.KDE

Princípios e Técnicas de EEG

Aula 12

2.KDE

Princípios e Técnicas de EEG

Aula 12

2.KDE

Princípios e Técnicas de EEG

Aula 12

2.KDE

Fonte: Altman and Krzywinski (2018)

Princípios e Técnicas de EEG

Aula 12

2.KDE

Que tal estimar a entropia sem estimar diretamente a densidade de probabilidade?

Princípios e Técnicas de EEG

Aula 12

2.KDE

Princípios e Técnicas de EEG

Aula 12

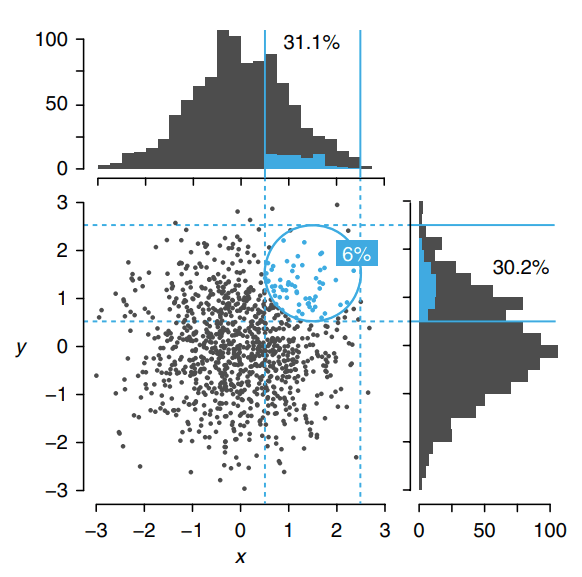

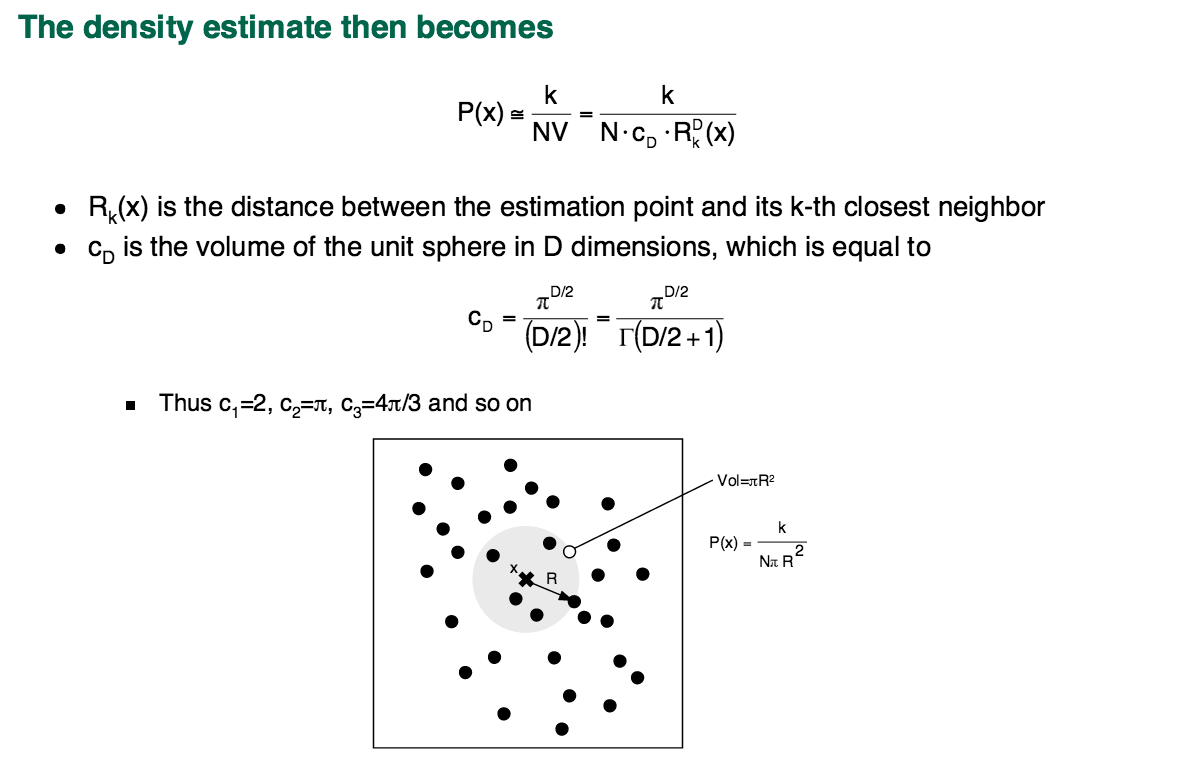

3. k-NN

Princípios e Técnicas de EEG

Aula 12

3. k-NN

Que tal eliminar a escala antes de tudo?

Princípios e Técnicas de EEG

Aula 12

3. k-NN

Princípios e Técnicas de EEG

Aula 12

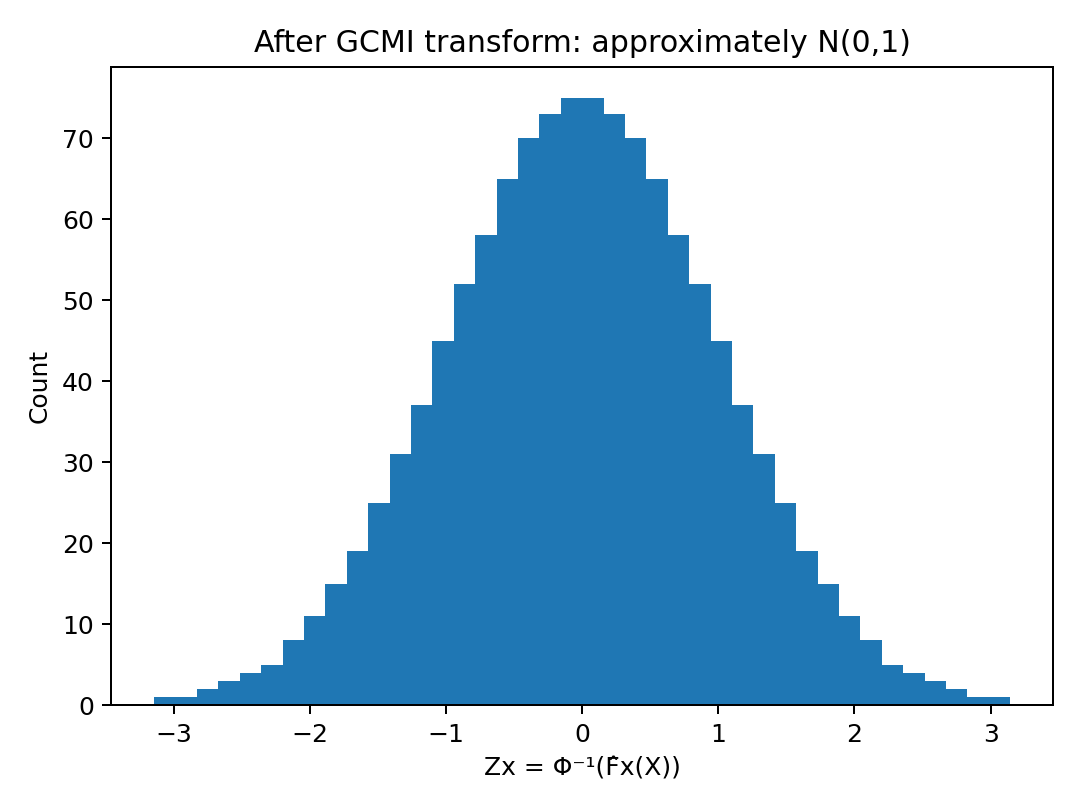

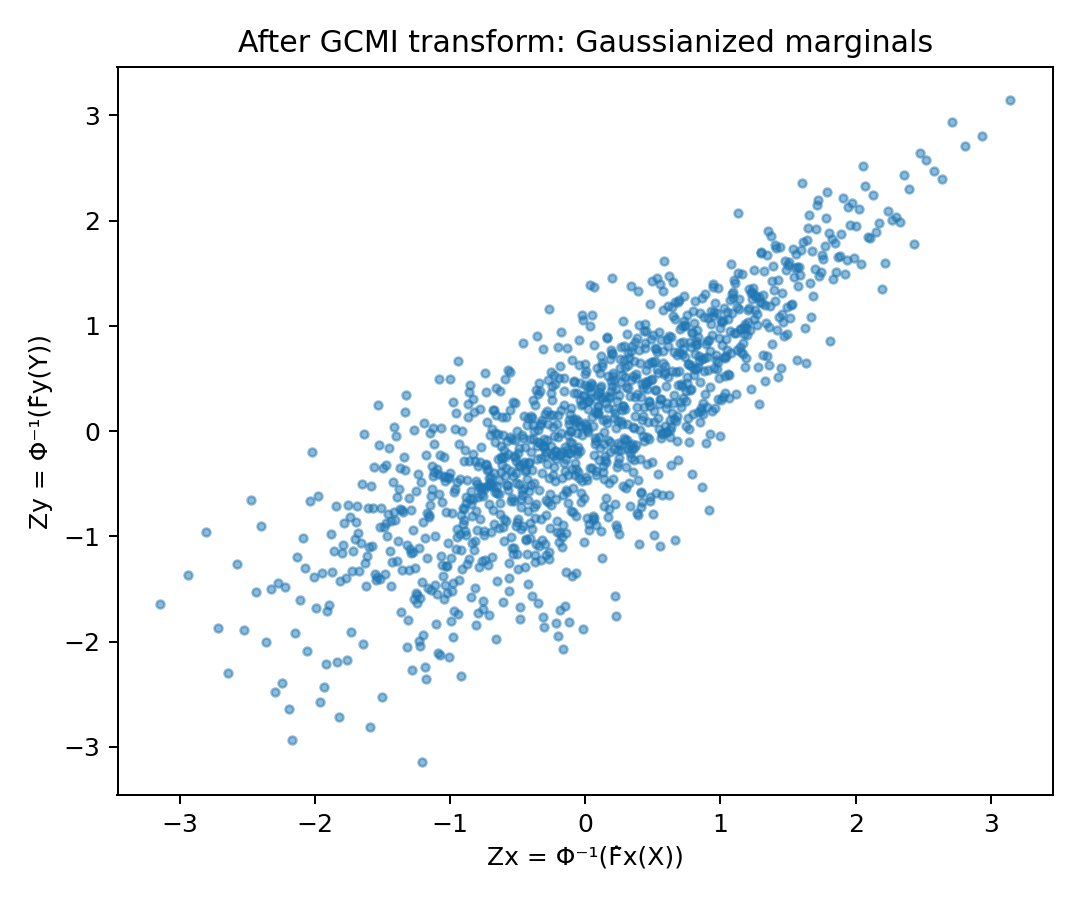

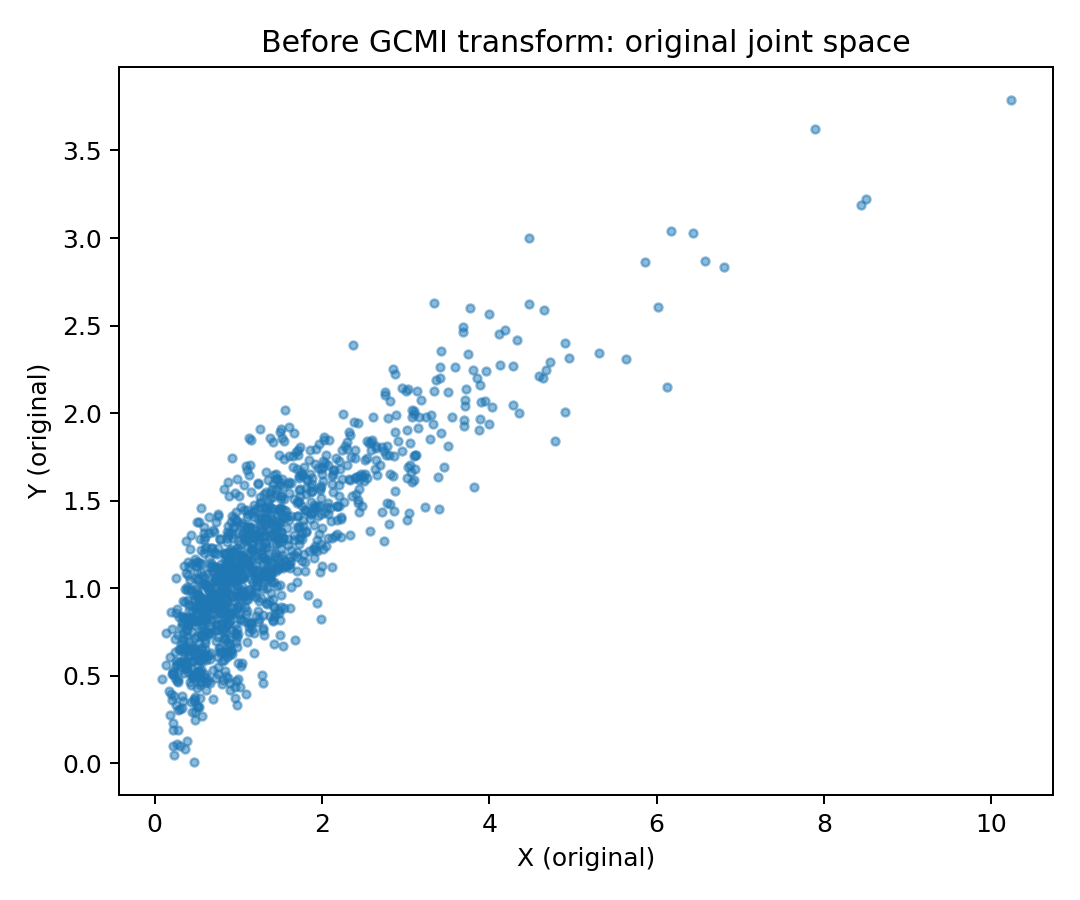

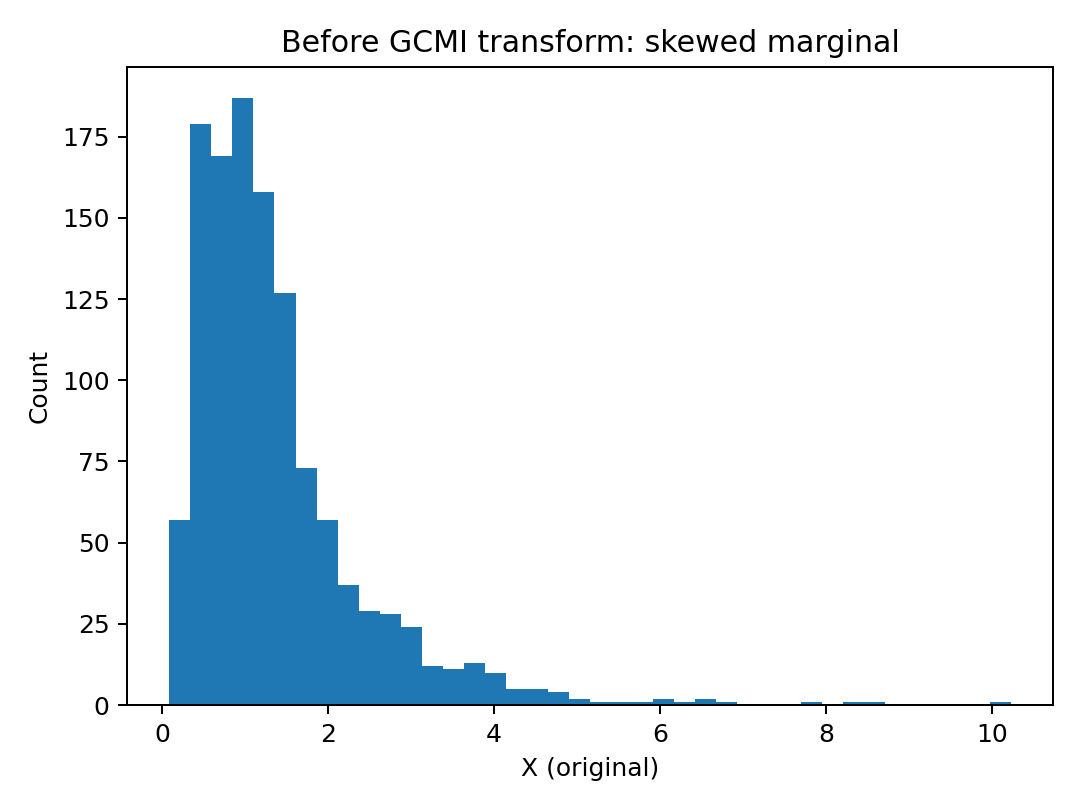

4. GCMI

Princípios e Técnicas de EEG

Aula 12

4. GCMI

Princípios e Técnicas de EEG

Aula 12

4. GCMI

Princípios e Técnicas de EEG

Aula 12

4. GCMI

Na próxima aula...

Entropia de Gibbs

Entropia de Boltzmann

Entropia de Shannon

Entropia Aproximada

Entropia de Perturbação

Entropia Multiescala

Entropia Espectral

Entropia de Tsalis

Entropia de Von Neumann

Entropia de Transferência

Entropia de Kolmogorov-Sinai

Entropia de Réniy

Entropia de Bekenstein

Entropia de Hawking

Entropia Conjunta

Entropia Condicional

Entropia Algorítmica

Entropia Fuzzy

Princípios e Técnicas de EEG

Aula 12

PRINCÍPIOS E TÉCNICAS DE ELETROENCEFALOGRAFIA EM NEUROCIÊNCIA

Próximas Aulas:

AULA 13 (Tópicos Avançados) - As muitas entropias do EEG

AULA 14 - Ritmos do EEG

Instituto de Ciência e Tecnologia

Graduação em Engenharia Biomédica

Prof. Dr. Adenauer G. Casali

Laboratório de Neuroengenharia e Computação

casali@unifesp.br

Tópicos Avançados - Aula 12 - Como estimar entropia na prática

By ADENAUER GIRARDI CASALI

Tópicos Avançados - Aula 12 - Como estimar entropia na prática

- 9