PRINCÍPIOS E TÉCNICAS DE ELETROENCEFALOGRAFIA EM NEUROCIÊNCIA

AULA 13 - As Muitas Entropias do EEG

Instituto de Ciência e Tecnologia

Graduação em Engenharia Biomédica

Prof. Dr. Adenauer G. Casali

Laboratório de Neuroengenharia e Computação

casali@unifesp.br

PRINCÍPIOS E TÉCNICAS DE EEG EM NEUROCIÊNCIA

As muitas entropias do EEG:

1. Entropia na biologia e física,

2. Entropia e incerteza,

3. Princípio de Landauer,

4. Entropia de Kolmogovor-Sinai,

5. Approximate entropy/sample entropy,

6. Multiscale entropy,

7. Permutation entropy,

8. Spectral entropy.

Adenauer G. CASALI

AULA 13

Nesta aula, nós veremos...

As muitas entropias

Entropia de Gibbs

Entropia de Boltzmann

Entropia de Shannon

Entropia Aproximada

Entropia de Perturbação

Entropia Multiescala

Entropia Espectral

Entropia de Tsalis

Entropia de Von Neumann

Entropia de Transferência

Entropia de Kolmogorov-Sinai

Entropia de Réniy

Entropia de Bekenstein

Entropia de Hawking

Entropia Conjunta

Entropia Condicional

Entropia Algorítmica

Entropia Fuzzy

Princípios e Técnicas de EEG

Aula 13

Escalas da vida: macro-estável, micro-estocástico!

"Microstates": estocástico

"Macrostate": estável

Homeostase: processo de auto-regulação que estabilizam você em microestados que resultam em você ser você!

Fenótipo: repertório de estados nos quais um organismo pode existir

Micro x Macro: ENTROPIA

1. Entropia na Física

Princípios e Técnicas de EEG

Aula 13

Mecânica estatística

Microscópico

Macroscópico

(energia cinética, posição, velocidade, etc...)

(Energia Interna, Volume, Temperatura, Pressão, etc...)

Entropia de um Sistema em um dado Macroestado

Número de microestados que resultam no mesmo macroestado

1. Entropia na Física

Princípios e Técnicas de EEG

Aula 13

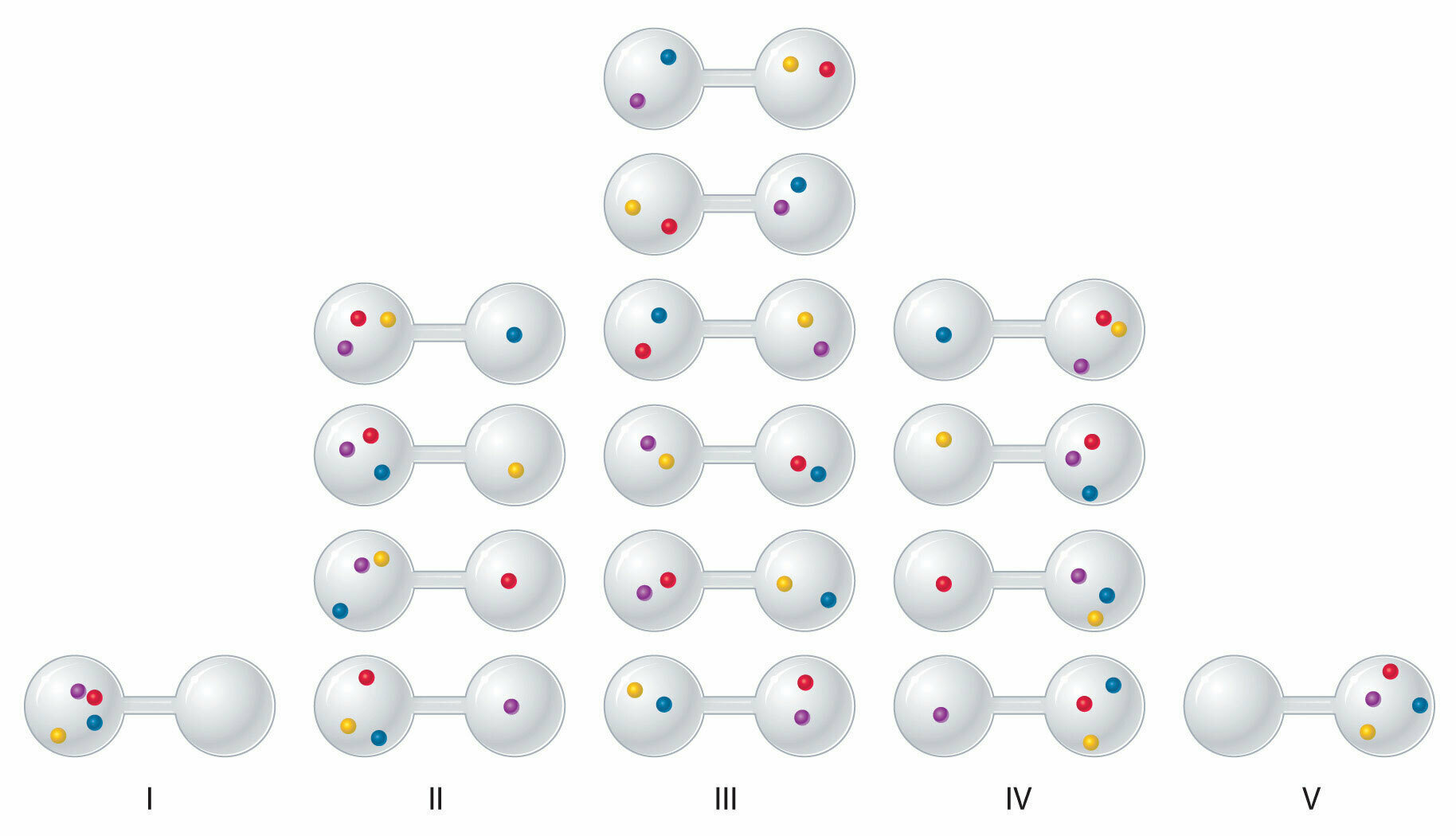

Exemplo: 4 moléculas em duas câmaras

Quantas configurações?

"Macroestados"

Probabilidades das configurações:

= número de microestados

1. Entropia na Física

Princípios e Técnicas de EEG

Aula 13

Entropia de um macroestado: medida do número de possíveis microestados naquela configuração (em escala logarítmica)

Boltzmann:

Generalização de Gibbs:

De uma perspectiva macroscópica, os sistemas evoluem em direção ao estado mais provável. E, se todos os microestados forem igualmente provávels, o macroestado mais provável é o que tem o maior número possível de microestados.

1. Entropia na Física

Princípios e Técnicas de EEG

Aula 13

probabilidade de um determinado X ter uma configuração específica x dentre todas as configurações possíveis

Probabilidade baixa = surpresa ao descobrir a configuração de X. Quanto maior a "surpresa" ao descobrir X, mais "informação" X contém.

Entropia = informação média de X (medida de "surpresa")

Entropia em termos de informação: "redução de incerteza", "surpresa"

Informação da configuração x(em escala log):

2. Entropia e Incerteza

Princípios e Técnicas de EEG

Aula 13

Para apagar um bit de informação em temperatura T é necessário gastar energia

Princípio de Landauer (1961)

o que corresponde a um aumento de entropia termodinâmica de

Perda de informação

precisa ser compensada por aumento de entropia física!!!

Informação não é algo abstrato: Informação é fisicamente corporificada em sistemas!

Bennett (1982): computação finita NÃO É REVERSÍVEL (porque precisa apagar memória!)

Teoria da Informação é parte da Física Fundamental Contemporânea

(ver por exemplo Parrondo et al., 2015)

3. Princípio de Landauer e Computação

Princípios e Técnicas de EEG

Aula 13

Mas em termos de EEG, calcular a entropia de Shannon é só o começo...

- Sample Entropy

- Approximate Entropy

- Multiscale Entropy

- Permutation Entropy

- Spectral Entropy

- Transfer Entropy

- ....

Aproximações operacionais da entropia de Shannon sob diferentes restrições

Definem diferentes estimadores de informação

(mas a ideia de fundo é sempre a mesma!)

As muitas entropias: Entropias do EEG

Princípios e Técnicas de EEG

Aula 13

Entropia de Kolmogorov-Sinai (KS)

4. Entropia de Kolmogorov-Sinai

Princípios e Técnicas de EEG

Aula 13

"Chain rule" (regra da cadeia)

4. Entropia de Kolmogorov-Sinai

Princípios e Técnicas de EEG

Aula 13

"Chain rule" (regra da cadeia)

4. Entropia de Kolmogorov-Sinai

Princípios e Técnicas de EEG

Aula 13

Entropia de Kolmogorov-Sinai (KS)

"Chain rule" (regra da cadeia para entropias)

4. Entropia de Kolmogorov-Sinai

Princípios e Técnicas de EEG

Aula 13

Entropia de Kolmogorov-Sinai (KS)

4. Entropia de Kolmogorov-Sinai

Princípios e Técnicas de EEG

Aula 13

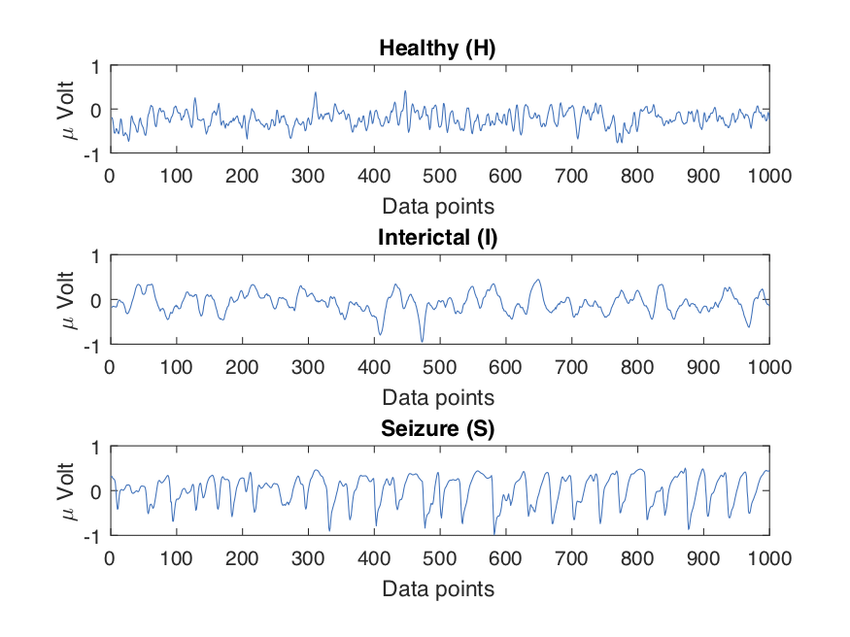

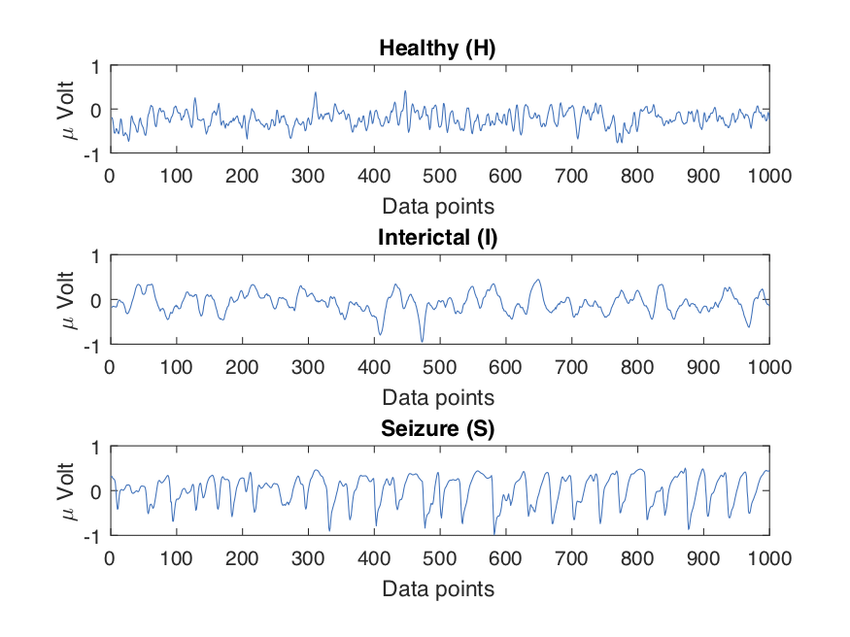

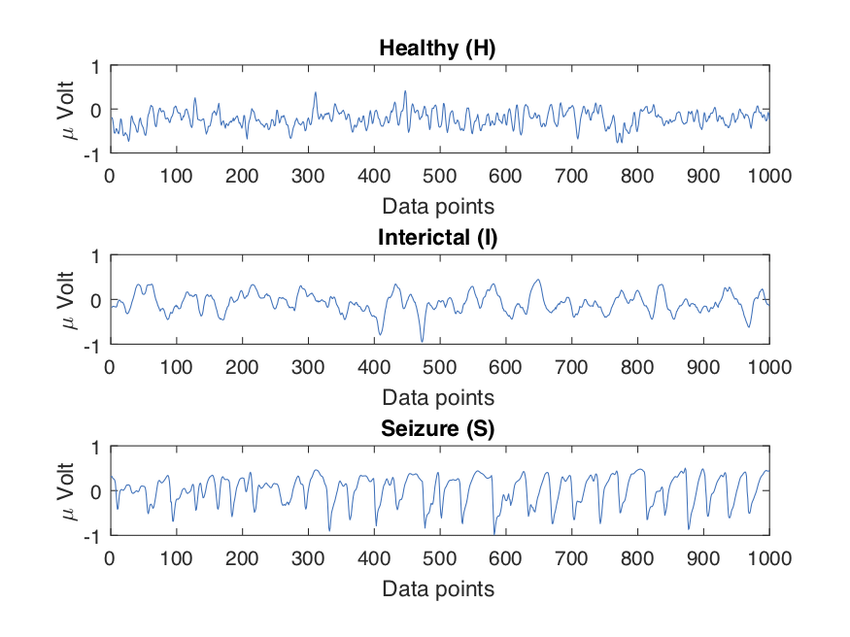

Approximate Entropy/Sample Entropy: estima de KS

Introduzida por Steven Pincus: PNAS (1991)

Refinada por Joshua Richman: American Journal of Physiology (2001)

5. Approximate Entropy/Sample Entropy

Princípios e Técnicas de EEG

Aula 13

Approximate Entropy

?

5. Approximate Entropy/Sample Entropy

Princípios e Técnicas de EEG

Aula 13

Approximate Entropy

Sample Entropy

5. Approximate Entropy/Sample Entropy

Princípios e Técnicas de EEG

Aula 13

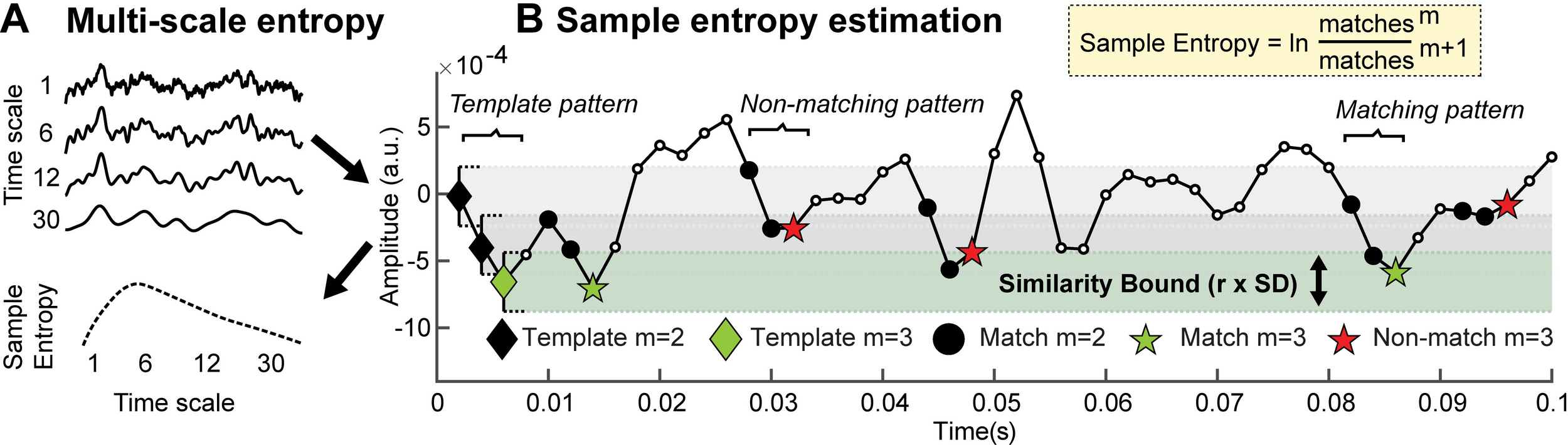

Multiscale Entropy

Introduzida por Costa et al.: PRL (2002)

6. Multiscale Entropy

Princípios e Técnicas de EEG

Aula 13

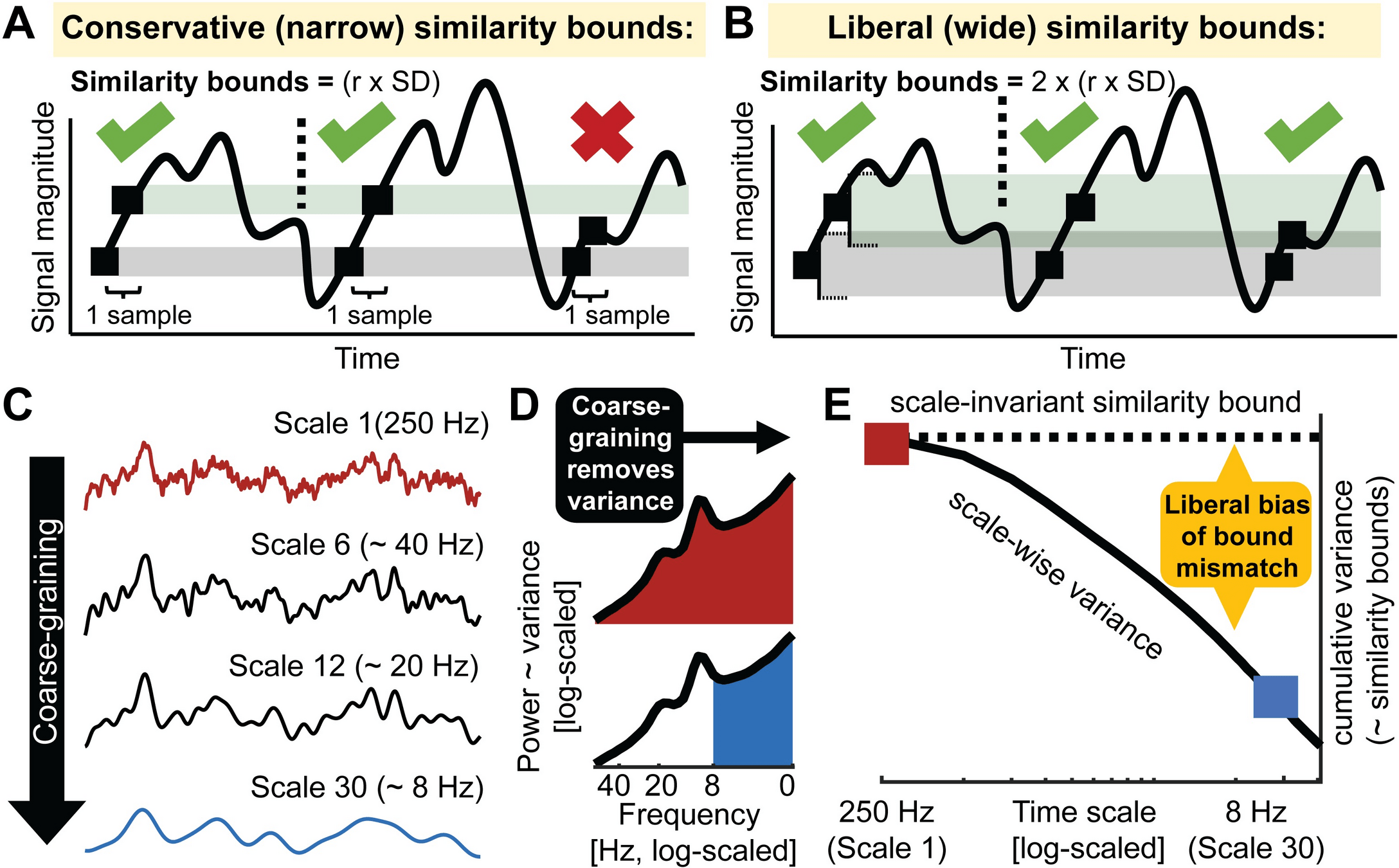

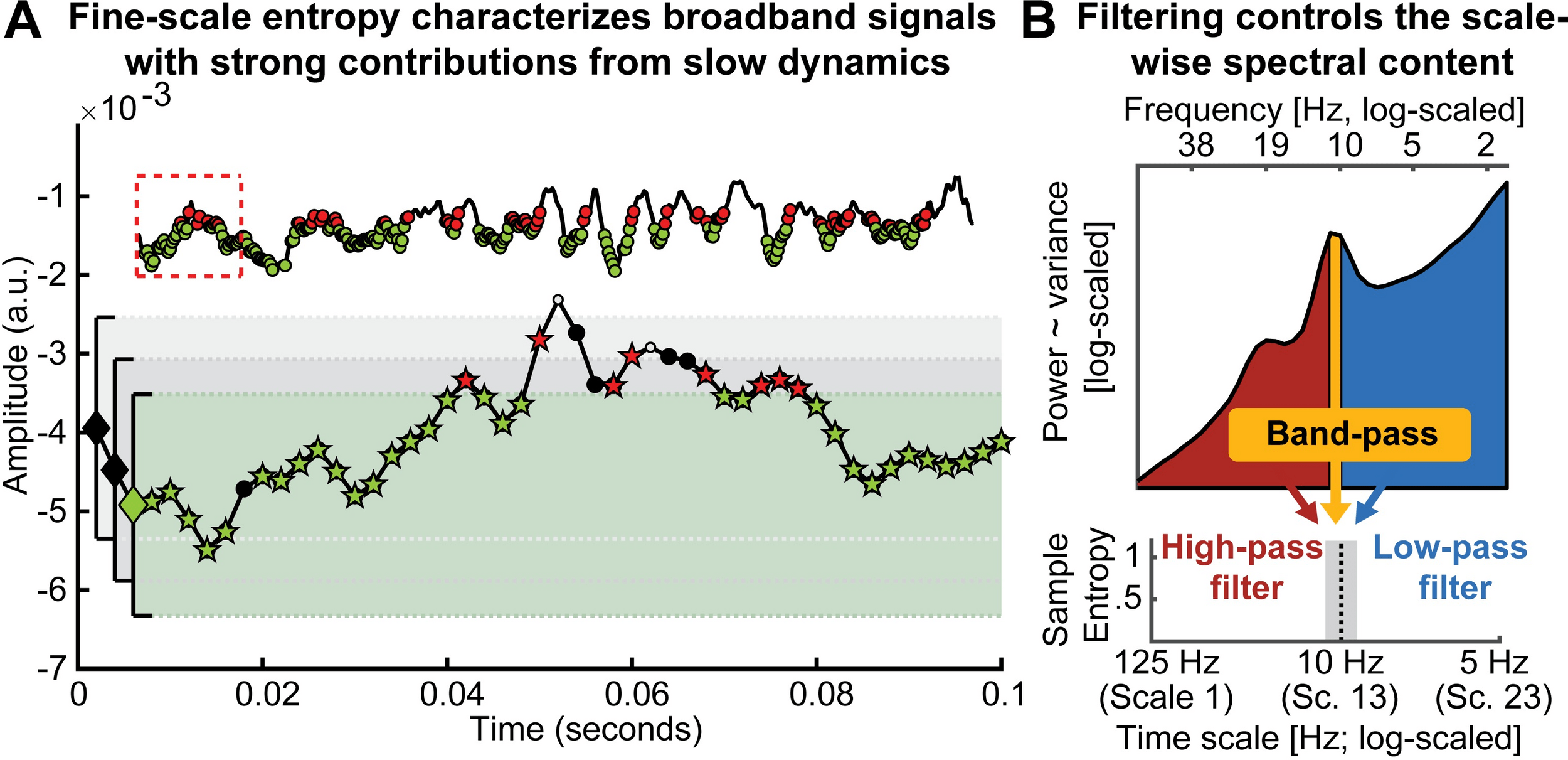

Fonte: Kosciessa et al., 2020

6. Multiscale Entropy

Princípios e Técnicas de EEG

Aula 13

Multiscale Entropy

Fonte: Kosciessa et al., 2020

6. Multiscale Entropy

Princípios e Técnicas de EEG

Aula 13

Multiscale Entropy

6. Multiscale Entropy

Princípios e Técnicas de EEG

Aula 13

Fonte: Kosciessa et al., 2020

6. Multiscale Entropy

Princípios e Técnicas de EEG

Aula 13

Permutation Entropy

Introduzida por Band and Pompe: PRL (2002)

7. Permutation Entropy

Princípios e Técnicas de EEG

Aula 13

Permutation Entropy

7. Permutation Entropy

Princípios e Técnicas de EEG

Aula 13

Permutation Entropy

Há também versões "Multiscale" da Permutation Entropy!

7. Permutation Entropy

Princípios e Técnicas de EEG

Aula 13

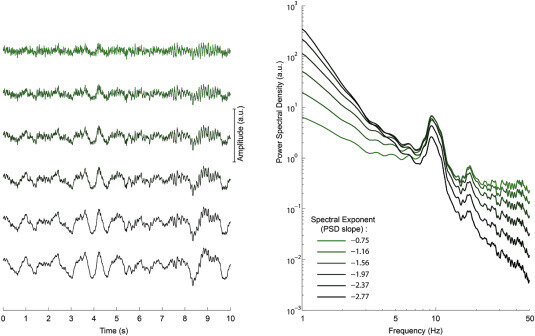

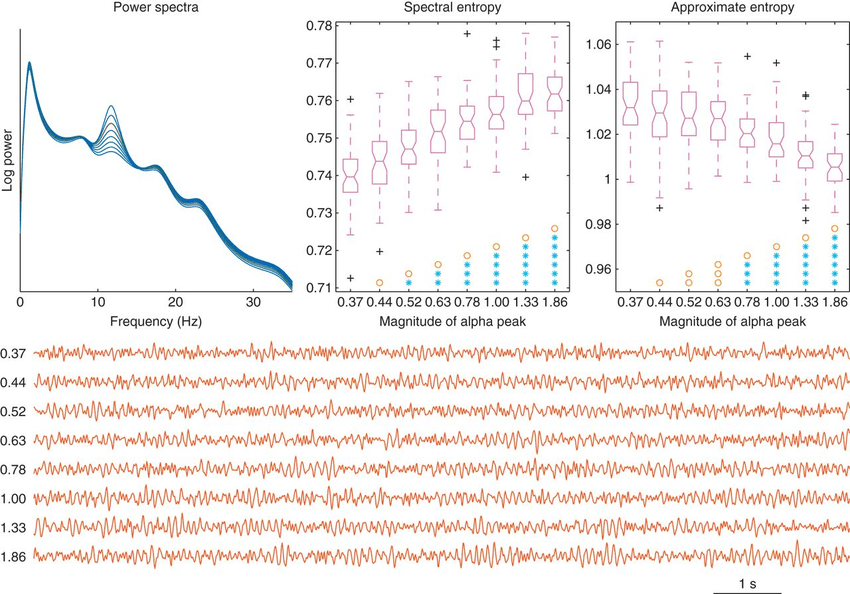

Spectral Entropy

Fonte: Colombo et al., 2019

8. Spectral Entropy

Princípios e Técnicas de EEG

Aula 13

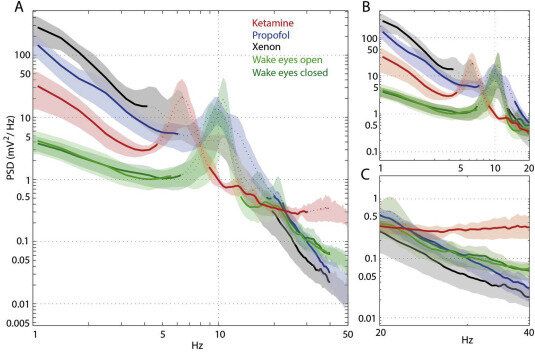

Fonte: Anier et al. (2012)

8. Spectral Entropy

Princípios e Técnicas de EEG

Aula 13

Spectral Entropy

Fonte: Colombo et al., 2019

8. Spectral Entropy

Princípios e Técnicas de EEG

Aula 13

PRINCÍPIOS E TÉCNICAS DE ELETROENCEFALOGRAFIA EM NEUROCIÊNCIA

Próximas Aulas:

AULA 14 - Ritmos do EEG

AULA 15 (Tópicos Avançados) -Conectividade Funcional

Instituto de Ciência e Tecnologia

Graduação em Engenharia Biomédica

Prof. Dr. Adenauer G. Casali

Laboratório de Neuroengenharia e Computação

casali@unifesp.br

Tópicos Avançados - Aula 13 - As muitas entropias do EEG

By ADENAUER GIRARDI CASALI

Tópicos Avançados - Aula 13 - As muitas entropias do EEG

- 9